快科技3月3日消息,“重要的事情說兩遍。”這聽起來像是玄學,但確實是真的。

2026年,當很多的人還在費盡心機設計複雜提示詞,想讓AI更好地聽懂人類需求時,谷歌研究院悄悄發佈了一篇論文,提出了一個簡單到讓人意外的方法——重複提示詞,就能大幅改善大語言模型在非推理任務上的表現。

方法簡單到離譜:

先寫好你的需求提示詞,再把它複製一遍、粘貼在後面,直接發給AI就可以。

比如:

之前你的提示詞是:“這是我的問題”。

現在把它換成:“這是我的問題”“這是我的問題”,然後餵給AI。

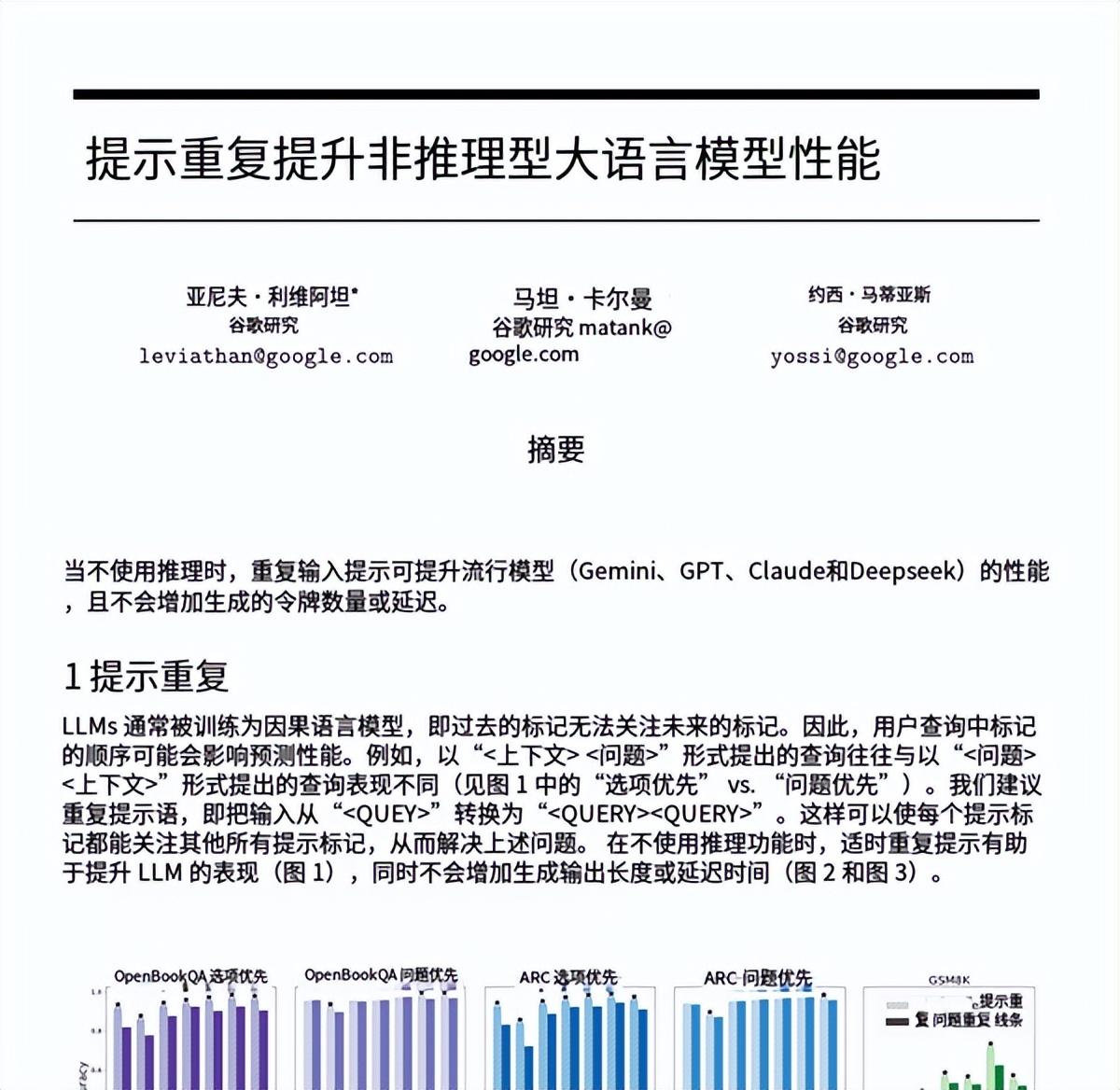

這篇論文名爲《提示重複可增強大語言模型非推理性能(Prompt Repetition Improves Non-Reasoning LLMs)》,它的核心結論,徹底顛覆了人們對AI提示詞設計的固有認知。

整個論文比較長,我用AI總結了一下核心意思:

“谷歌研究團隊發現了一個優化大語言模型的簡單實用方法:在不需要模型做邏輯推理的場景下,把輸入的提示詞完整重複一遍,能明顯提升模型的回答準確率,還幾乎不會增加生成內容的長度和響應耗時。

大模型本身無法讓提示詞裏的信息相互關聯,提示詞的順序還會影響回答效果,而重複提示詞能讓這些信息彼此呼應,且這個重複操作只在模型的並行預處理階段完成,不會影響後續的內容生成。

團隊測試了Gemini、GPT、Claude 等7個主流模型,在多項標準任務和 2個自定義任務中,無推理場景下該方法47 次提升模型性能且0次失效,自定義任務裏模型準確率甚至從21.33%飆升至 97.33%。

但讓模型逐步推理時,這個方法效果一般,因爲推理型模型本就會自主重複部分提示詞。

實驗還證實,性能提升是因爲重複提示詞本身,而非單純增加輸入長度,重複三次在部分任務中效果更好。該方法基本不改變輸出格式,能直接適配現有系統,僅 Claude 處理超長內容時延遲會稍增,是個易落地的輕量優化方案。”

說白了,這就是我們從小聽到大的“重要的事情說兩遍”,沒想到這個樸素的道理,在AI身上同樣管用。

爲了驗證這個方法是否可行,谷歌研究團隊做了嚴謹測試,選取了Gemini、GPT-4、Claude、DeepSeek等7個主流大模型,在70種不同場景下展開驗證。

結果出人意料:47個場景中,AI的表現有明顯提升;23個場景中表現持平;全程沒有出現因爲重複提示詞,導致AI表現變差的情況。

論文中設計了一項名爲NameIndex的測試,具體來說,就是給AI一份包含50個名字的長名單,然後問它“第25個人叫什麼名字”。

這項任務對人類來說,只要逐個數一遍就能完成,但對AI而言,要在長長的序列中精準定位,難度不小。常規操作下,Gemini 2.0 Flash-Lite模型的準確率只有21.3%,幾乎和瞎蒙沒區別;而使用重複提示詞的方法後,準確率直接飆升到97.3%,提升幅度超過4倍,從幾乎無法使用的狀態,變得近乎完美。

而且這種提升不是個例,像數學題、代碼理解這類不需要極強推理能力的任務,重複提示詞都能帶來穩定的效果提升。

這個看似很笨的土辦法,背後其實有明確的科學邏輯,並非什麼玄學。

當前主流的大語言模型,都採用Transformer架構,它有一個明顯的短板,只能單向閱讀。AI讀取提示詞時,就像我們看直播彈幕一樣,只能逐詞往後看,讀到前面的內容時,根本不知道後面會講什麼,很容易遺漏關鍵信息。

而重複提示詞,相當於讓AI做了一次“虛擬重讀”(Virtual Re-reading),當它讀第二遍內容時,已經對整體情況有了瞭解,就能借着第一遍的記憶,精準抓住那些真正重要的信息,從而提高響應的準確性。

不過,這個技巧也不是萬能的,存在明顯的侷限性。谷歌論文中也明確提到,它對OpenAI的o1、國產DeepSeek-R1這類主打深度推理(Reasoning)的模型,效果並不明顯。

原因很簡單,這類模型在給出答案之前,內部已經完成了類似反覆琢磨的過程,這時再在外部重複提示詞,就顯得多此一舉了。

另外,如果提示詞本身已經很長,快達到模型的上下文上限,再複製一遍,可能會導致AI處理速度變慢,甚至出現內存溢出的情況。

除此之外,這個技巧更適合信息提取、閱讀理解這類任務,要是讓AI寫小說、寫詩,重複提示詞不僅不會讓文采變好,反而可能讓AI感到困惑。

業內人士認爲,這一研究也給大家提了個醒,優化AI性能,未必非要依賴複雜技術,有時候最樸素的方法,反而能帶來意外驚喜。

對普通用戶來說,以後遇到AI答非所問,或者處理長文檔時丟三落四的情況,不用急着花心思改寫複雜提示詞,不妨試着把自己的需求複製粘貼一遍再發送。

畢竟“重要的事情說兩遍”,這份人類幾千年來總結的智慧,在AI身上同樣適用,也能讓我們以極低的成本提升使用體驗。

網友評論:

“真是不可思議,如此簡單粗暴的方法居然效果這麼好。這讓我不禁思考,還有多少顯而易見的技巧我們因爲沒人系統地測試而錯過了。

對於這個領域來說,有點尷尬的是,“重複兩遍哈哈”竟然也算是一種合法的優化策略。

這是一篇極具洞察力的論文。令人印象深刻的是,如此簡單的技巧竟能顯著提升非推理模型的性能。Gemini 2.0 Flash-Lite僅通過重複提示,就能在特定任務中將準確率從 21.33% 提升至 97.33%,這着實令人驚歎。

我還發現,由於重複操作是在可並行化的預填充階段處理的,因此延遲不受影響,這一點尤其令人感興趣。感謝分享,我一定會付諸實踐。”

大家不妨都試試。