第一軍情軍事評論員 魯源

這幾天,人們的目光被德黑蘭上空的爆炸聲所吸引,卻似乎忽視了來自AI界的一條重大新聞。

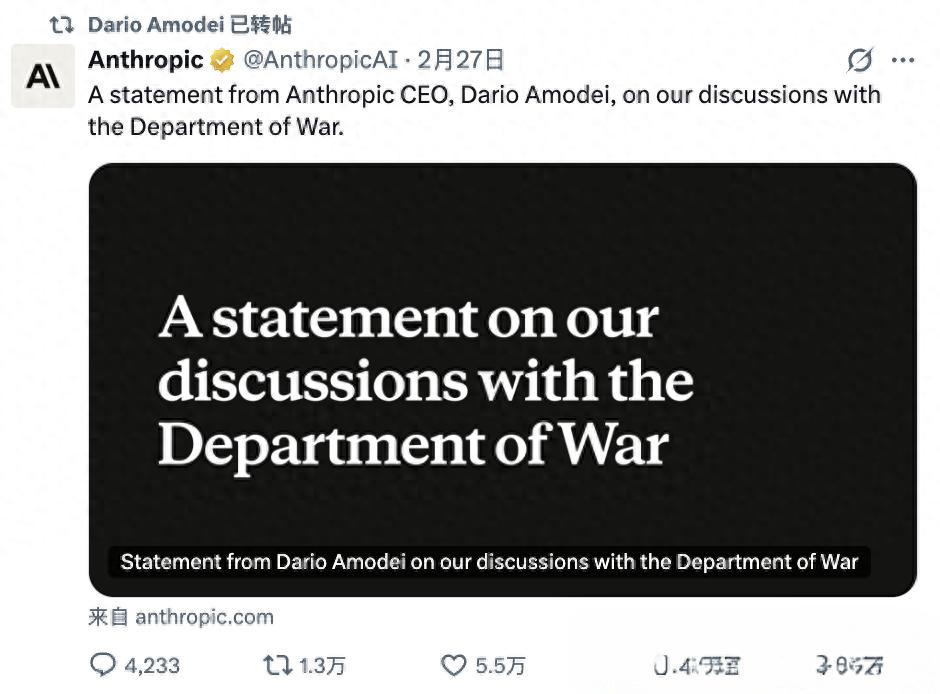

2月27日下午,華盛頓時間5時01分,硅谷的一家AI公司,被自己的政府“封殺”了。

罪名?拒絕殺人。

這家公司叫Anthropic,估值3800億美元,旗下大模型Claude,原本是唯一被允許接入五角大樓機密系統的商業AI。就在24小時前,它的CEO阿莫迪還在說:“我們在良心上無法同意他們的要求。”

24小時後,美國總統特朗普親自下場,宣佈所有聯邦機構立即停用Anthropic技術。國防部長皮特·赫格塞思緊接着又宣佈,將Anthropic列爲“供應鏈風險企業”——這個標籤,以前只給外國對手。

而就在第二天,2月28日,德黑蘭的爆炸聲中,美軍用Claude完成了包括最高領袖在內的40位伊朗高官的精準清除。

這24小時,是一家硅谷公司與華盛頓的決裂,也是AI戰爭史上一道分水嶺。

一、紅線之爭:“安全優先”撞上“所有合法用途”

故事,要從一個月前說起。

2026年1月初,美軍在突襲抓捕委內瑞拉總統馬杜羅的行動中,使用了Claude。Anthropic公司事後從媒體上得知此事,向五角大樓求證,並表達了“深度關切”。

關切的不是“用沒用”,而是“怎麼用”。

Anthropic給Claude設了兩條紅線:不得用於完全自主武器系統,不得用於對美國公民的大規模監控。這是它從創立之初就標榜的“安全優先”品牌——這家由OpenAI前核心成員創辦的公司,一直以“最負責任的AI”自居。

但五角大樓要的是“所有合法用途”無限制使用。

2月24日,美國防長赫格塞思親自約談阿莫迪,要求對方撤掉所有限制。阿莫迪拒絕了。五角大樓隨即發出最後通牒:2月27日下午5點01分前,要麼配合,要麼出局。

同一天,馬斯克的xAI與五角大樓簽約,接受了“所有合法用途”條款。一個標杆,已經擺在那裏。

二、特朗普開炮:“覺醒主義”vs“偉大軍隊”

2月27日下午4時,距離截止時間還剩一小時。

特朗普在社交媒體上親自下場:“美國絕不允許極端左翼、覺醒主義企業干涉偉大軍隊如何作戰並贏得戰爭!Anthropic的那些左翼瘋子企圖脅迫‘戰爭部’遵從該公司的服務條款而不是我們的憲法,這是一個災難性錯誤。”

特朗普命令所有聯邦機構“立即停止”使用Anthropic技術,設6個月過渡期。赫格塞思隨即宣佈,將Anthropic列爲“國家安全供應鏈風險企業”。

五角大樓官員甚至對阿莫迪本人發起攻擊,稱這位CEO“一心只想試圖親自掌控美國軍隊,並甘願將國家安全置於危險之中”。

三、OpenAI的“光速滑跪”:聲援歸聲援,合同歸合同

就在Anthropic被政府封殺的同一時刻,它的老對手OpenAI做出了截然不同的選擇。

2月27日,OpenAI宣佈與五角大樓達成協議,將公司AI模型部署於五角大樓的機密網絡。CEO奧特曼一邊在社交媒體上聲援Anthropic——“我基本信任這家公司,我認爲他們確實非常重視安全問題”——一邊簽下了合同。

OpenAI創立之初爲非營利性質,也曾禁止將技術用於軍事領域。然而,從2024年開始放寬限制,如今連公司宗旨說明中的“安全”兩字都已去掉,只說“造福全人類”。

同日,OpenAI宣佈最新一輪融資估值達到7300億美元,融資1100億美元。資本的邏輯,從來就不等人。

四、Anthropic也是雙面人:一邊刪紅線,一邊舉良心

2月24日,就在被五角大樓召見的前一天,Anthropic其實已經悄悄刪除了自己安全政策中的“硬性紅線”——那個承諾“觸及危險閾值就暫停訓練”的條款,被替換成更靈活的“透明披露”機制。外界解讀:這是準備讓步的信號。

一邊標榜自己是“最負責任的AI”,一邊在政府施壓下已經開始鬆動“安全優先”邊自己先把底線的繩子鬆了鬆。這種說一套做一套的雙面人姿的承諾;一邊用所謂“良心”當擋箭牌對抗軍方,一態,連好萊塢編劇都不敢這麼寫。

馬斯克乾脆在X上補了一刀,話雖然刻薄,但角度刁鑽:“他們怎麼敢‘偷竊’Anthropic從人類程序員那裏偷來的東西?”——言下之意:大模型本來就是用全人類的數據訓練的,誰比誰更“原創”?

事實上,所謂的“安全優先”,原來也是有價格的。今天可以用“良心”跟政府討價還價,明天就可以用同樣的邏輯跟商業對手談判。只可惜,五角大樓沒喫這一套——他們要的是絕對服從,不是討價還價。

五、最諷刺的24小時:封殺、空襲與補刀

如果把時間線拉長,諷刺感似乎會更濃。

2月24日:Anthropic悄悄刪除了安全紅線。

2月27日:Anthropic被政府封殺。

2月28日:就在封殺後幾小時,美軍用Claude對伊朗發動空襲,哈梅內伊身亡。德黑蘭上空的爆炸聲,宣告了一場“沒有Anthropic的AI戰爭”照樣打響了。

馬斯克在X上又一次補刀:“Anthropic憎恨西方文明。”

而OpenAI的550多名員工簽署公開信,支持Anthropic的立場,呼籲各自公司的領導層對五角大樓的要求說“不”。弔詭的是,他們公司的合同,已經簽了。

六、權力對決:誰來決定 AI 的生死線?

Anthropic與五角大樓的這場“決裂”,表面是“兩條紅線”之爭,實質是一個更深的問題:當AI越來越強大,誰有權決定它如何被使用?

是創造它的公司?還是掌控戰爭機器的美國政府?

喬治城大學人工智能政策專家海倫·託納說,這揭示了一種根本性的“認知脫節”:在華盛頓,官員們將AI視爲一種可被用於特定目標的新工具;而在硅谷,技術創造者則越來越將其視爲一種具備複雜推理能力的“實體”,可能以不可預測且危險的方式行事。牛津大學一位研究AI治理的學者說得更直接:“這本質上是關於國家權力與公司之間,誰有權決定AI如何在世界上被部署的問題。”

但問題是:當Anthropic這樣的美國公司一邊用“良心”當擋箭牌對抗政府,一邊自己已經在悄悄鬆動“安全優先”的承諾時,它所謂的“底線”,到底還有幾分真誠?

七、德黑蘭之後:“良心”敗了,戰爭贏了

2月28日,德黑蘭的爆炸聲過後,一個問題擺在那裏:

如果Anthropic拒絕讓步,美軍就用不了Claude——這是這家公司的“良心”。但結果呢?空襲照樣進行,一衆伊朗高官照樣身亡。區別只在於,Claude的名字,沒有出現在戰報裏。

3800億的“良心”,五角大樓不買賬。不是因爲良心太貴,而是因爲戰爭不需要良心。

資本能買來技術,權力能找到替代品。但那個“誰來決定AI底線”的問題,不會隨着合同終止而消失。

特朗普說,Anthropic犯下了“災難性錯誤”。

也許,真正的災難性錯誤是,當一家公司試圖用“良心”定義自己的底線時,卻發現這條底線本身,早已被自己親手鬆動了。

德黑蘭的廢墟里,埋着的不僅是伊朗高官,還有那個“AI安全優先”的童話。

這就是現實。