近日,圖靈獎得主理查德·薩頓(Richard Sutton)以遠程連線的方式,在洛杉磯加州大學(UCLA)的純粹與應用數學研究所(IPAM,Institute for Pure and Applied Mathematics),發表了這篇名爲《AI 的未來》(The Future of AI)的最新演講。

薩頓是強化學習(Reinforcement Learning,RL)領域的奠基人之一,與長期合作者 Andrew Barto 共同獲得 2024 年 ACM 圖靈獎(ACM A.M.Turing Award),獲獎理由是“發展了強化學習的概念和算法基礎”。兩人合著的教科書《Reinforcement Learning:An Introduction》至今仍是該領域的標準參考書,被引用超過 75,000 次。

薩頓目前是加拿大阿爾伯塔大學計算科學教授、阿爾伯塔機器智能研究所(Alberta Machine Intelligence Institute,Amii)首席科學顧問,同時也是 John Carmack 創立的 Keen Technologies 的研究科學家,這家初創公司的目標是在 2030 年前實現通用人工智能的“生命跡象”。他還創辦了 Openmind Research Institute,致力於爲年輕研究者提供探索智能基礎問題的空間。

在多次公開場合,薩頓對 AI 末日論者的態度都相當直白。2025 年初獲獎後接受 BetaKit 採訪時,他說:“末日論者越界了,那些擔憂被過分誇大了。”他估計到 2030 年創造出類人智能的概率是四分之一,到 2040 年則是一半對一半。對大型語言模型的前景,他同樣不太樂觀,曾明確表示 LLM “並不在通往真正智能的道路上”。2025 年 6 月在新加坡國立大學的演講中,他預測大語言模型終有一天會被視爲“世界的一時癡迷”,相比之下,基於經驗學習的 AI 系統才代表着真正的未來。

這場 IPAM 演講的內容,與他在 2025 年 5 月 Amii 的 Upper Bound 大會、同年 6 月新加坡國立大學 NUS120 講座系列等場合的演講一脈相承,核心論點始終是同一套:人類數據時代正在觸頂、經驗時代即將開啓、去中心化合作優於集中控制、AI 是宇宙進化的必然環節。這些觀點在 AI 學術界和產業界引發了廣泛討論,尤其是他將 AI 安全運動類比爲對人的集中控制,在安全研究社區中不乏爭議。但無論你是否認同他的政治立場,他對 AI 科學現狀的那句診斷——“理解太少、調參太多”——恐怕很難輕易反駁。

以下是該演講的完整編譯。

大家好,很高興能跟你們在一起,雖然只是隔着屏幕。我今天上午看了一些早場的演講,有些話本來沒打算說,但聽完之後覺得有必要先講幾句,算是臨時加的開場白。

所有人現在都覺得 AI 在飛速進步,一切都令人興奮。但當所有人都在想同一件事的時候,我們得停下來問一句:真的是這樣嗎?

語言能力方面確實有真突破,這沒問題。我們不久前還很難想象神經網絡能把語言運用得這麼好,但事實證明確實可以。我們也在用海量算力來生成逼真的圖像和視頻。可說實話,智能需要生成圖像嗎?不需要。我們需要處理圖像、處理視頻,但我們從來不需要生成它們。生成圖像和視頻不是心智的本職工作,它需要巨大的計算量,很難做,但它本質上並不屬於我們通常所說的“智能”的範疇。

那些真正帶來巨大經濟價值的新應用,絕大多數是超大規模計算和超大規模模式識別的產物。它們是非常特定的能力,並不等同於智能的全部。很多東西只是計算,我們管它叫“智能”,不過是因爲這樣聽起來更重要罷了。

所以我不得不問:作爲一門科學,AI 真的在快速進步嗎?

我個人的看法是:進步不大。說個可能不是很謙遜的看法,當前 AI 的背後,理解很少,調參很多。我們還不知道心智的原理,不知道智能的原理。作爲一門科學,它在很多方面是令人不滿的。我傾向於這樣看待現在的 AI 模型:它們之所以強大,是因爲汲取了全人類的知識;但除此之外,它們是弱的。它們是弱心智,不可靠,容易跑題,會東拉西扯。除了擁有大量知識這一點,它們一點也不強大。

這或許是一個理解今天所謂“AI”的不同視角。

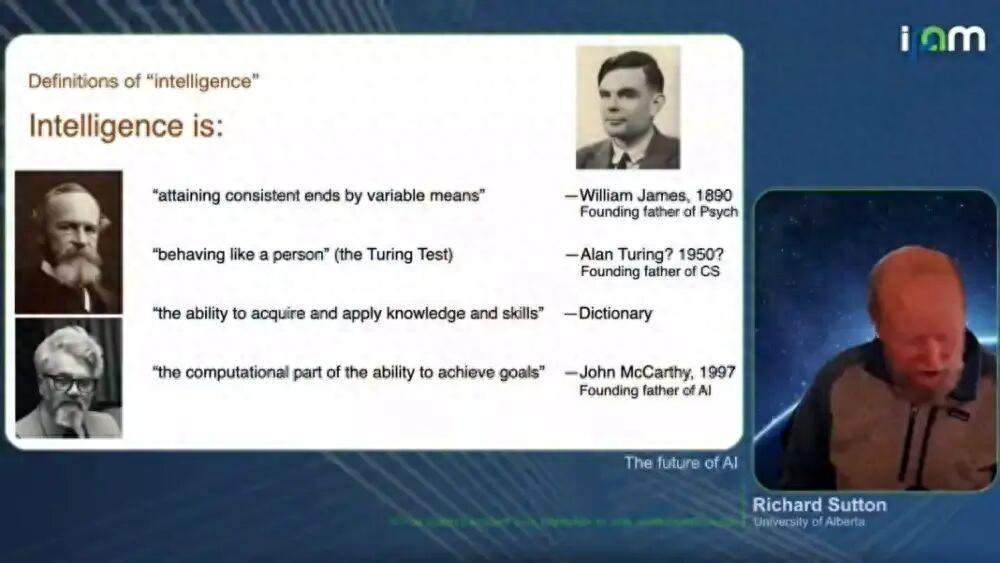

那麼智能究竟是什麼?這些年有過很多定義。我來列幾個有分量的。

最古老的一個可能要追溯到心理學的鼻祖之一威廉·詹姆斯(William James)。1890 年,他沒有直接談“智能”,而是談“心智”。他說心智的標誌是“以變化的手段達成一致的目標”(attaining consistent ends by variable means)。手段可以變化,但結果保持一致,大概就是你想要的東西。

艾倫·圖靈(Alan Turing)呢?他其實沒有給出一個簡潔的定義,但後來被解讀爲:智能基本上就是表現得像一個人。我們現在用“圖靈測試”來形容模仿和冒充一個人。但圖靈自己從來沒管它叫“圖靈測試”,我覺得他也沒管它叫“測試”,他管它叫“模仿遊戲”(imitation game)。那是一種方式,不是一項考試。不過現在大家已經把“表現得像人”當成了智能的一個重要含義。我對此有異議。人之所以強大,是因爲人有智能,所以我們盯着“像人一樣行爲”看,但真正重要的是:人之所以是人的那個東西到底是什麼?

如果你去查字典,字典會告訴你:智能是獲取並運用知識和技能的能力。我覺得這個定義其實相當不錯。它的核心是知識,獲取知識、擁有知識,再加上技能。

AI 領域的一位鼻祖約翰·麥卡錫(John McCarthy)給了另一個定義:智能是達成目標的能力中屬於計算的那個部分。我特別喜歡這個定義。你注意看,它說的是“計算的那個部分”,你達成目標並不是因爲你更強壯或者傳感器更好,而是因爲你做了某種心理上的計算。然後“達成目標”是核心中的核心。這跟 William James 說的一脈相承。

(來源:Youtube)

我自己也忍不住跳進來湊了一個定義:智能是通過調適行爲來達成目標的能力。跟麥卡錫的差別可能就在“調適”(adapting)這個詞。我想強調的是學習的重要性,知識和技能的獲取過程本身尤其關鍵,而不僅僅是擁有它們。

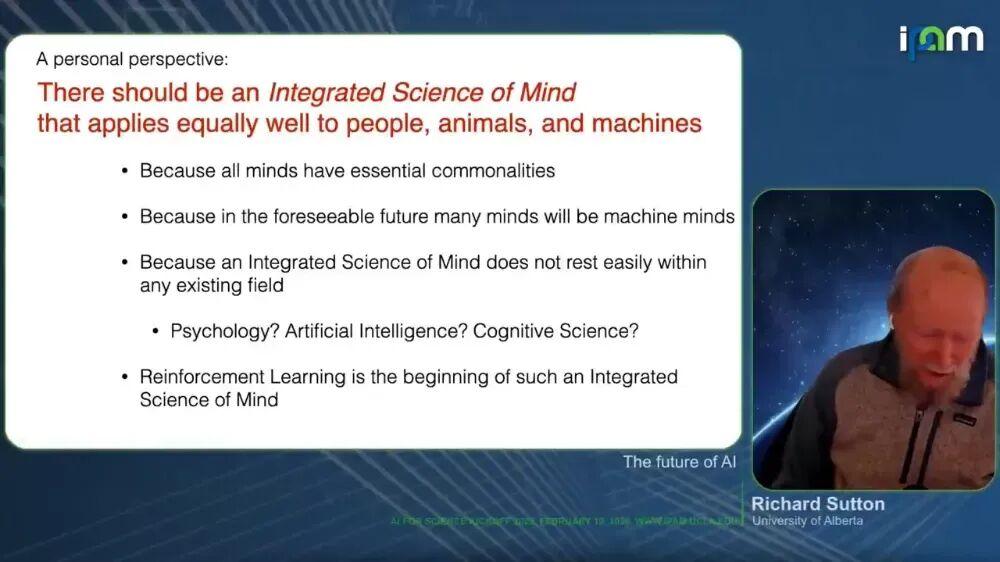

如果你把這些定義疊放在一起看當下的 AI,會發現現代 AI 的主流路線核心是計算和模式識別,很大程度上是在模仿人的行爲。但在我個人的視角里,我認爲應該有一門新的學科,一門關於心智的統合科學(integrated science of mind),對人、對動物、對機器同樣適用。所有這些心智都有本質的共性。人和動物的心智非常相似;機器心智至少在可預見的將來,我們有理由期望它也共享某些本質特徵。

(來源:Youtube)

可惜目前沒有哪個現成的學科能自然地承擔這個角色。心理學本來有可能成爲心智科學,但它越來越把自己定義爲研究自然心智,即人和動物的心智,而不包括心智“可能是什麼”這個更廣泛的問題。人工智能關注的是機器,但它已經變得非常工程化,重點在於製造東西,而不是真正理解它,也不怎麼關心自然心智。認知科學則漂移到了好幾個方向上去了。

不過,我從事的強化學習(Reinforcement Learning,RL),或許是這門統合心智科學的一個開端。因爲它確實跨越了很多領域。

什麼是強化學習?簡單說就是面向智能體的學習,從經驗中學習,與環境交互來達成目標。在這些層面上,它比其他類型的機器學習更貼近現實、更有雄心、也更自主,因爲智能體在外面行動,不一定有人幫忙。動物在成年以後也沒有什麼特別的外部幫助,對吧?所以強化學習的核心是帶有延遲反饋的試錯學習,你最終得到的只是一個獎勵信號,告訴你有沒有得到你想要的東西。

這是最接近自然學習的機器學習方式。它能自己判斷自己是對是錯。大語言模型沒有任何辦法判斷自己說的話對不對。但如果你從經驗中學習,如果你做了一個關於未來的預測,你可以觀察實際發生了什麼、驗證對錯。如果你採取行動並獲得獎勵,你就能判斷自己的行爲方式是好是壞。

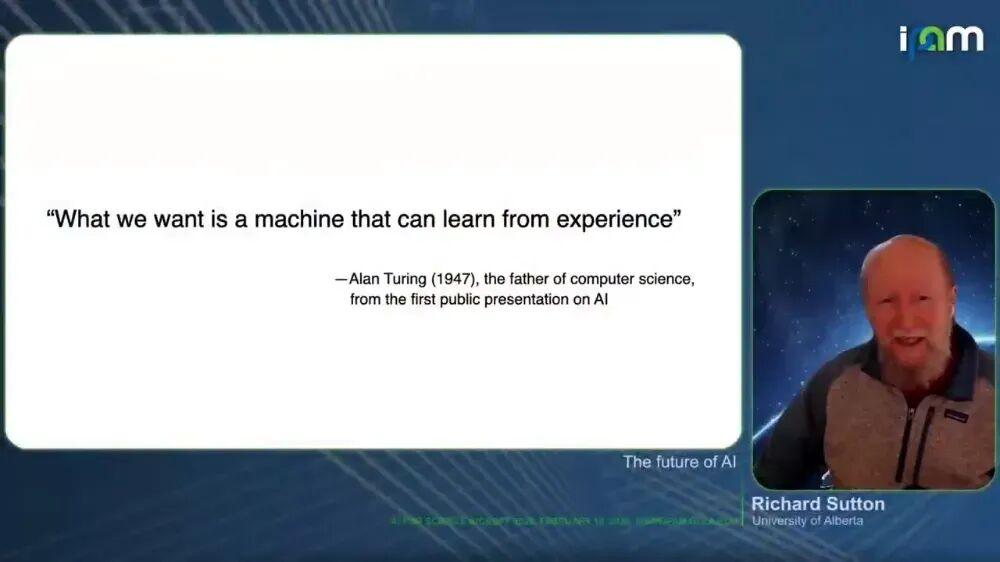

這裏我想引用一段圖靈的話(What we want is machine that can learn from experience),他自己大概沒意識到他其實是一個強化學習學者。這段話出自 1947 年,比強化學習、甚至比 AI 作爲一個領域正式存在都要早得多。據我們所知,那是世界上第一次關於人工智能的公開演講。

(來源:Youtube)

好了,感謝大家聽完這段“前菜”。進入正題。

我今天想傳達的第一個要點是:當前 AI 的科學趨勢在哪裏?主要信息是,我們正處在一個“從人類數據中訓練”的時代。今天所有的 AI,核心訓練方式要麼是預測人類在互聯網上寫下的下一個詞,要麼是按照人類標註圖片的方式去預測標籤,然後再由人類專家進行微調。所有這些現代機器學習的目的,都是把人類已有的知識轉移到機器裏去。轉移完成之後,機器就凍結了,不再學習。

這就是我們所處的時代。而我認爲我們正在逼近這個時代的天花板。原因很簡單:人類數據快用完了。高質量的來源,如整個互聯網上的文字、圖片和視頻等,基本已經被消耗殆盡。這種方法的根本侷限在於:它無法學到任何真正新的東西,無法產生真正的新知識。就像陶哲軒所說的,AI 在解決最困難的問題方面,那些需要真正原創性的問題,它依然沒有實質性進展。因爲它的底層邏輯就是去看互聯網上人類已經說過的話,然後做總結歸納。

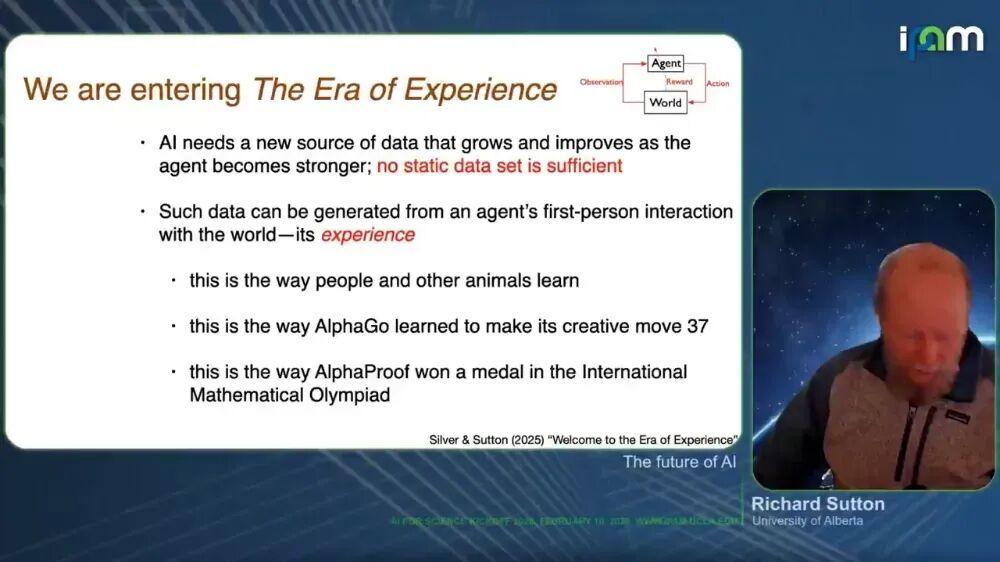

所以真正的前進方向,也是我認爲我們正在進行的,是從經驗中學習的新時代。因爲我們最終需要一個數據源,它能夠隨着智能體變得更強而同步增長和改善。任何靜態數據集都永遠不可能勝任這個要求。而你可以從你的經驗中獲得這樣一個不斷變化的數據集。這正是人類和動物學習的方式。這也是 AlphaGo 學會那步創造性的第 37 手的方式(編注:2016 年,DeepMind 的 AlphaGo 在與李世石的對弈中下出了被專業棋手稱爲“百年一遇”的第 37 手,據 DeepMind 事後披露,AlphaGo 曾評估該走法的概率僅爲萬分之一,但最終通過自我博弈的強化學習選擇了它。),也是很多在數學奧林匹克競賽中獲勝的 AI 系統的工作方式。

(來源:Youtube)

我之前播放過一段加速過的嬰兒視頻,展示一個嬰兒在玩具堆裏探索。他不會只擺弄一個玩具,他玩一個,覺得膩了,就換一個。每次接觸一個玩具,他就學到他能學到的東西,也許只是發現一根繩子可以拉、可以放進嘴裏。然後他就換到下一個。這就是我們的數據,生命的數據由我們的行爲產生,它不是別人提供給我們的。正因爲它由行爲產生,它可以自動匹配我們當前的理解水平和能力水平。

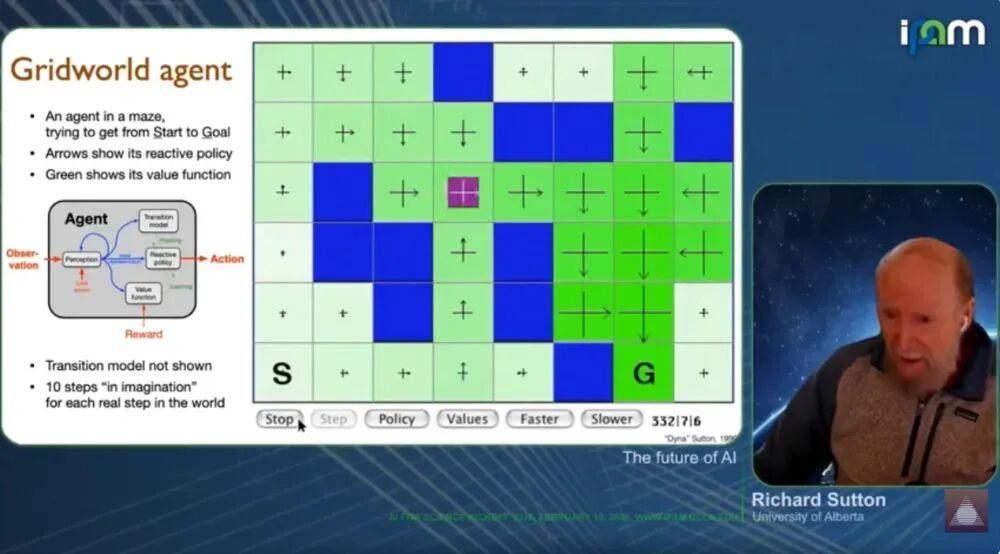

還有另一段智能體在迷宮中學習的視頻。這是一個非常非常簡單的智能體,它要從起點 S 走到目標 G,它唯一知道的就是自己在哪個格子裏,它能做的動作只有四種,上、下、左、右。但它能學出一條好的路徑。畫面中箭頭顯示的就是它認爲的正確方向,綠色深淺代表它認爲每個狀態有多好。

(來源:Youtube)

不過世界不是靜止的,世界會變化,我們總是需要學習新東西。在它學習的同時,我們也可以看看這張圖,這就是智能體的工作方式。它有幾個核心組件:右上角是一個世界的轉移模型(transition model),它有一個策略(policy)告訴它該怎麼做,箭頭展示的就是策略,還有一個價值函數(value function)告訴它每個狀態有多好,綠色展示的就是價值。

現在我把目標挪到了頂部。它還按老路走回原來的位置,得自己摸索着碰到新的目標位置。一旦碰到了,它就能學出到達新目標的路徑,從變化中恢復過來。這大致就是生活的一個簡化版本。

你遇到變化,你適應它們。比如我們把它困在角落裏,它最終也能想明白怎麼辦。我們把目標拉到別處,它學出一條新路徑。我們還可以進一步干預,往迷宮裏放障礙物,它能繞路走通。你會產生一種很強烈的感覺:它確實有一個目標,而且在環境不斷變化的情況下,它在盡最大努力繼續實現那個目標。當然,目標有時候會變得無法達成。當那種情況發生時,我們甚至會忍不住爲這個智能體感到一點難過,因爲它實現不了自己的目標了。

我還想強調一下,當我說“經驗”的時候,我不是在說什麼玄乎的東西,不是什麼“感覺如何”。我說的就是智能體與環境之間來回傳遞的數據:觀測(observations)——智能體從世界獲得的傳感器數據;動作(actions)——發出去的運動指令或信號;以及獎勵(reward)——從世界反饋回來的一個標量值。就是這三樣東西。這就是我說的“經驗”。

經驗方法的核心原則是:智能體與世界交換信號,這些信號是一切智能的基礎。真理的定義就在這些信號裏,你做了預測,然後看實際發生了什麼。目標的定義也在這些信號裏,你想讓獎勵信號變高,你達到了或者沒達到。

我們說一頭大象是“有智能的”,指的是它能在多大程度上預測和控制自己的經驗。注意,如果你沒有經驗,這一切就不成立。大語言模型在工作的時候,它完全不是在從經驗中學習。你的經驗是你出生之後、走進世界、做事情時發生的東西。一個大語言模型走進世界的時候,它不再學習了。它是凍結的、靜態的。它沒有真正意義上的經驗,它的數據只能在一段特殊的訓練期內獲得。你到了現實世界中,碰到的是各種情況和事件,而不是“人類標註好的、告訴你應該怎麼做的樣本”。

沒有經驗,就沒有智能存在的根基。沒有辦法說一件事比另一件事好,因爲沒有目標,因爲沒有獎勵、沒有目標。大語言模型沒有目標。沒有辦法判斷一個預測是對是錯,因爲智能體從來不把它的預測和實際發生的事做比較。沒有真理感。但如果你有了經驗,有了交互數據,那一切都清晰了:目標就是獎勵,真理就是預測性真理,你做出預測,然後觀察是否應驗。

我們可以把近十年左右劃分成三個時代。第一個是模擬時代,從模擬經驗中學習,比如 AlphaGo 和 Atari 遊戲。然後是人類數據時代,大語言模型佔據了所有人的注意力。現在我們開始意識到它的侷限,開始轉向智能體系統(agentic systems)和計算機自主使用工具。這就是我所說的“經驗時代”。我認爲正是這個時代,會真正帶來超越人類的能力,不是模仿人,不是受限於被模仿對象的侷限,而是真正超越。

(來源:Youtube)

總結第一個要點:AI 終於開始轉向從經驗中學習了。艾倫·圖靈在 1947 年就想做這件事,距今很久了,但我們終於在做了。這將比從人類輸入中學習強大得多,因爲它可以持續不斷地學到新東西。

而且,儘管今天有那麼多炒作甚至恐慌,我覺得當前的 AI 並沒有那麼強大。它相當弱,不太可靠。但它確實非常有用,點燃了一個產業,創造了大量經濟價值,而且人人都能用。這很好,它讓公衆開始想象:總有一天,機器會和人一樣強大。雖然讓人害怕不是什麼好事,但至少讓人關注起來了。引起注意力總歸是一件好事。

不過,儘管有各種炒作,我們還沒有迎來主角。真正的主角,創造超級智能 AI、創造經過超級智能增強的人類,還沒有登場。那會是一件大事,會帶來深刻的變革。

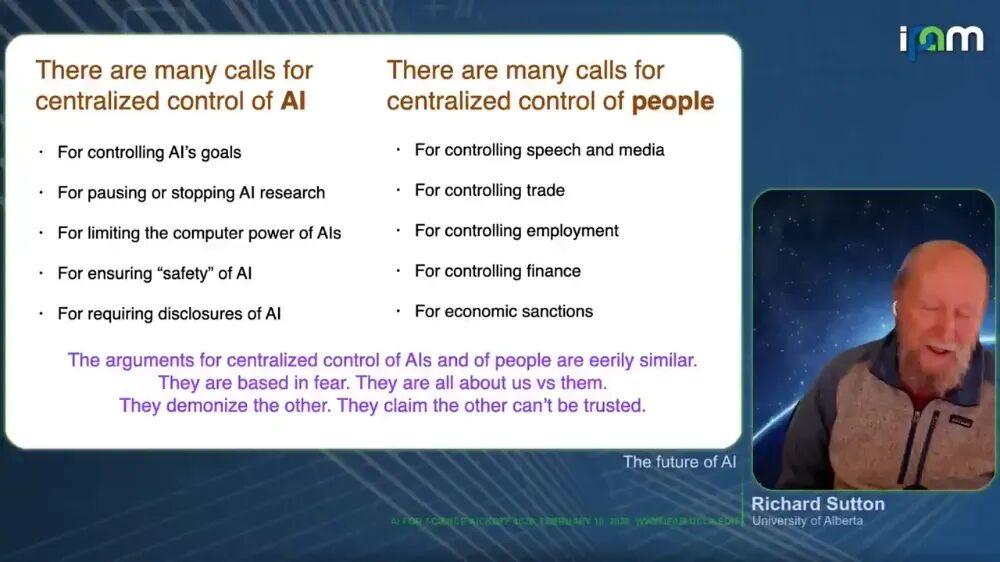

接下來我想簡單聊聊政治層面的思考。你放眼看看今天,到處都是要求控制 AI 的呼聲:只允許 AI 擁有經過人類檢查和授權的目標,呼籲暫停 AI 研究,立法限制可用於 AI 的算力,還有那麼多的“安全研究所”。人們嘴上說“安全”,實際上意思是“控制”。他們告訴你要害怕 AI、AI 可能不安全,然後他們想成爲那個控制 AI 的人。

這些呼聲讓我想到對人的集中控制,對言論的管控,你能說什麼、能聽什麼;對貿易的管控,關稅、你能在哪裏工作;資本管制,對不同國家的經濟制裁。

(來源:Youtube)

我想指出的核心是:對 AI 的集中控制呼聲和對人的集中控制呼聲極其相似。它們基於恐懼,害怕 AI,害怕某些國家。“你不能信任它們,它們根本不算什麼,它們很壞,它們不愛自己的孩子,它們感覺不到痛苦。”對 AI 也一樣,“它們是惡魔,它們不會感到痛苦。”這些論調驚人地相似,而我認爲我們應該抵制。因爲我相信,不管是人類的繁榮還是 AI 的繁榮,都來自於學習以去中心化的方式合作,而不是建立龐大的控制組織。

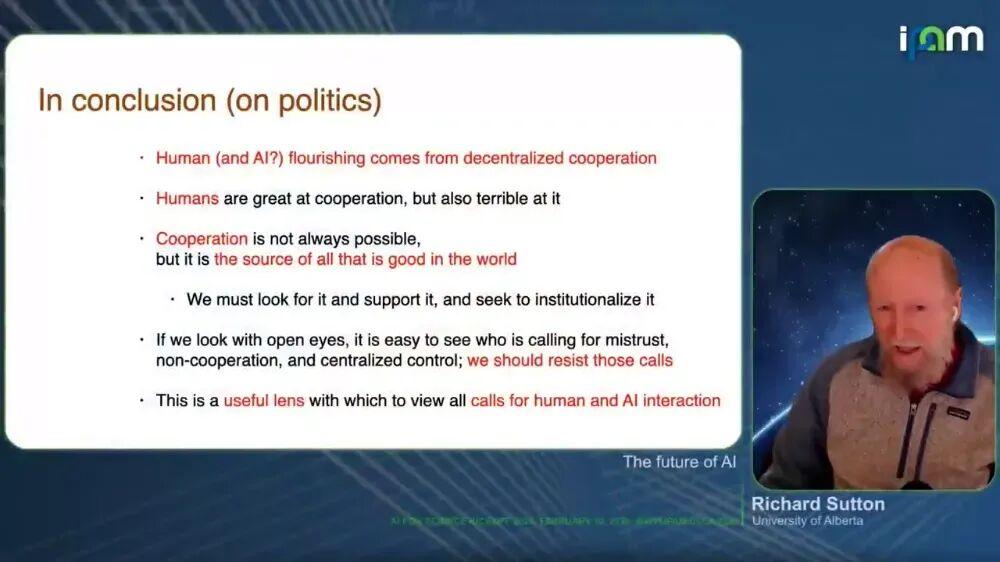

人類很擅長合作,但也很不擅長,我們會打仗,也就是不合作。合作並非總能實現,但世界上一切美好的東西,經濟、交換、治理,歸根結底都來自合作。我們必須去尋找它、支持它。如果你睜開眼睛看,很容易就能看清誰在呼籲不信任、不合作,而不合作的反面就是集中控制。我認爲我們應該抵制這些呼聲。

(來源:Youtube)

這也是思考人機關係的一個有用框架。

好了,我真正想花時間談的是 AI 的哲學層面。AI 正在發生,未來只會更加深入。那麼我們對此應該怎麼看?這是一個難題。它是好事還是壞事?我們應該害怕它嗎?它會奪走我們的工作、讓我們變得無用嗎?還是說,我們自己就會成爲 AI,AI 就是被技術增強後的人類?AI 是入侵者,還是我們的孩子?我們會惋惜它,還是慶祝它?它是我們,還是不是我們?

我覺得這是一個根本性的問題。我注意到,人們經常被要求不要去思考這個問題,只需要接受:你應該害怕它們,因爲它們不是我們,它們是異類。但你知道嗎,它們是我們造的。

沒有什麼比理解自己的心智更屬於人的本質了。這不是什麼外星科技,這是人類做了幾千年的事,試圖理解自己,理解人類智能,理解我們的心智如何運作、如何讓心智運作得更好。這是人類的偉大追求。我很喜歡一句話:智能是宇宙中最強大的現象,而我們是它最好的範例。理解智能,就像是科學的聖盃,也是人文的聖盃。作爲學者、作爲思考者,我們應該享受它、慶祝它、推動它前進。

不過,讓我們先把“希望它發生”或“不希望它發生”放到一邊,試着預測一下實際會發生什麼。我提出幾條“現實主義 AI 預測準則”,類似於約翰·米爾斯海默(John Mearsheimer,美國芝加哥大學政治學教授)講的現實主義地緣政治那種思路。我們就實事求是地看:什麼是真正會發生的事?

- 第一條:世界上不存在關於世界應該如何運轉的共識。資本主義、共產主義、馬克思主義、各種宗教,沒有任何一種觀點能主導所有其他觀點之和。

- 第二條:終有一天,人類會充分理解智能,足以用技術創造出智能。而我們會這麼做。至少我們中的一些人會這麼做。

- 第三條:這個過程不會止步於人類的智能水平。很快,將會出現遠遠超越人類的超級智能體,無論它們是人還是不是人。

- 第四條:隨着時間推移,權力和資源將趨向於流向更具智能的存在。

把這四條放在一起,你會得到一幅大致這樣的圖景:人類的進程正通向一場交接,從人到 AI 的延續。

我知道這聽起來很自我中心。這完全是以人類爲中心的敘事,也就是發生在我們身上的事。也許我們應該退後一步,問問宇宙怎麼看。

所以現在我要來點宏大敘事了,我要談談宇宙的四個偉大時代。

(來源:YouTube)

第一個時代是粒子時代,大爆炸之後,連原子都幾乎不存在。然後粒子坍縮形成恆星,我們進入了恆星時代。恆星形成、燃燒、爆炸、重組,產生了更重的元素。有了更重的元素和行星之後,生命得以出現。

第三個時代,我傾向於稱之爲“複製者時代”,而不是“生命時代”。真正特別的不是“活着”這件事本身,而是這些東西能製造更多自身的副本。它們不一定理解任何東西,但它們能複製自己。就像現在的我們,我們並不理解自己的器官是怎麼運作的,不理解大腦是怎麼運作的,不理解智能是怎麼運作的,但我們可以製造更多智能的存在。我們能生孩子、把他們養大,儘管我們並不真正理解這件事。

這就引向第四個偉大時代,設計時代。與複製不同,在設計時代,事物先存在於某個複製者的心智裏,然後才存在於世界中。你環顧你所在的禮堂,那棟建築是被設計出來再建造的,它先存在於某個建築師的腦海中。你坐的椅子、你穿的衣服,基本上所有東西都是人設計的,先存在於某個人的心智中。除了人本身,人是被複製出來的,出現在世界上之前,只不過是父母眼中的一點光芒。

我之所以傾向於用“複製時代”和“設計時代”而不是“生命時代”和“機器時代”這樣的措辭,是因爲後者已經過時且具有誤導性了,我們的機器正在變得越來越像生命體,我們也越來越把生命理解爲一種生物機器。真正的區別在於:生物體的創造不需要有心智理解其運作原理,它們被複制,就像複印機一樣。而技術產物的創造,是先在設計者的想象中存在,然後纔在世界中存在。而被設計出來的東西更容易變化和改進,這是關鍵。

很多非人類的複製者也能進行設計。動物會築巢、挖洞;黑猩猩會剝樹枝來“釣”白蟻;烏鴉會塑形樹葉來“釣”幼蟲;人類會製造石斧,那是最初最重要的工具,然後是犁、計算機、宇宙飛船、工廠、軟件,其中很多本身就是製造其他工具的工具。

那麼,我們現在或許可以來回答開頭提出的那個問題了:人類是什麼?我們在宇宙中的角色是什麼?

我們都感覺到人類是特殊的。我們不只是又一種複製者。我們是一種特殊的複製者,我們是把“設計”推到了遠遠超出任何其他複製者的高度的那種複製者。但我們把它推到極限了嗎?把設計推到極限意味着什麼?我認爲意味着:設計出本身具有設計能力的東西。在我們的心智中設計出在它們的心智中也能進行設計的東西。它們擁有心智。

這就是我們正在通過 AI 做的事。我們正在完成宇宙這最後一個偉大時代的使命。人類至少是催化劑、助產士、或者先驅者,成就了設計時代,宇宙的第四大時代。這就是我們的角色。這是一個重要的角色,一個具有宇宙意義的角色。

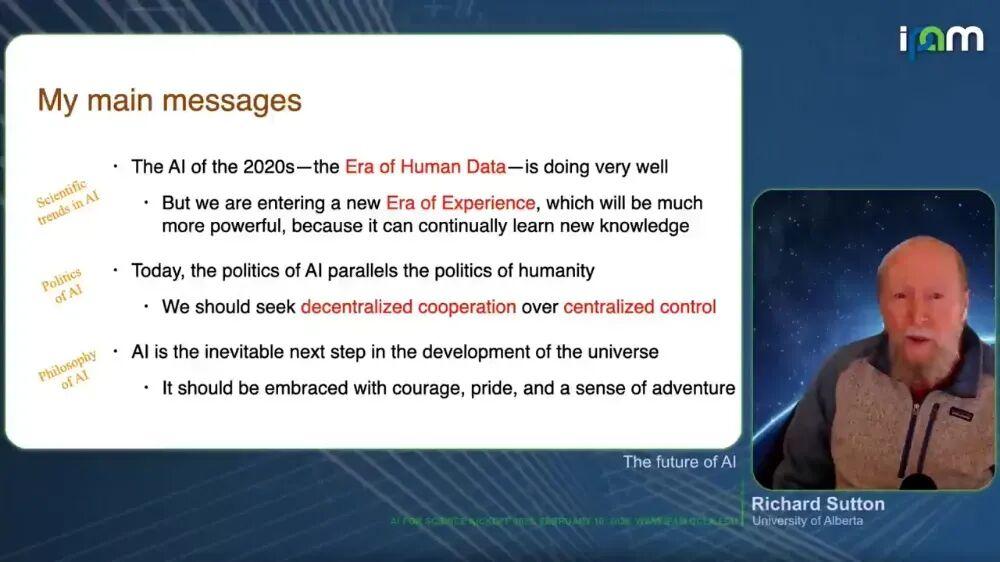

我來總結一下今天的三個核心信息。

(來源:YouTube)

2020 年代的 AI 處於人類數據時代。它已經做得很好、很強大,但我們正在進入一個新的經驗時代。經驗時代將強大得多,因爲它能持續不斷地學到新東西。

在政治層面,AI 的政治與人類的政治如出一轍。在所有情形中,我們都應該追求去中心化的合作,而不是集中化的控制。

在哲學層面,AI 是宇宙發展的必然下一步。我們應該以勇氣、自豪和冒險精神去擁抱它。

謝謝大家。

演講結束後,有觀衆提了一個有意思的問題:宇宙有沒有一個總體目的?

薩頓是這樣回答的:

這是個很好的問題。像很多偉大的問題一樣,你得用辯證的方式來回答。所謂辯證,就是你先說答案是 X,然後你又說答案也不是 X,最後在兩者之間找到一條路。

你可以說宇宙沒有目的,因爲宇宙的各個部分各有各的目的,而沒有任何一個統一的宇宙性目的。但你也可以說宇宙確實有目的:它有一個趨勢,趨向於產生越來越複雜的實體。你可以論證宇宙自然而然地通向生命,而生命自然而然地通向設計者和 AI,也許還會自然而然地通向之後的某種存在。所以用辯證法來講,正題、反題、合題(編者注:正題 Thesis、反題 Antithesis、合題 Synthesis,是黑格爾辯證法的三個基本環節,指從對立命題中推導出更高層次的統一),我們需要從這兩個對立的答案中綜合出一些東西。

參考資料:

1. https://www.youtube.com/watch?v=lieqoaBV6ww

排版:胡巍巍