由於被指 Gemini“指導”一名男子以自殺方式結束生命,谷歌正面臨一場涉及過失致死的訴訟案。

2025 年 10 月 2 日,美國佛羅里達州朱庇特鎮,36 歲的喬納森·加拉瓦斯(Jonathan Gavalas)把自己反鎖在家裏割開了手腕。幾天後,他的父親喬爾·加拉瓦斯(Joel Gavalas)撞開門,發現兒子躺在客廳地板上已經死了。電腦還開着,屏幕上是一行行和谷歌 Gemini 的聊天記錄,打印出來有 2,000 頁。

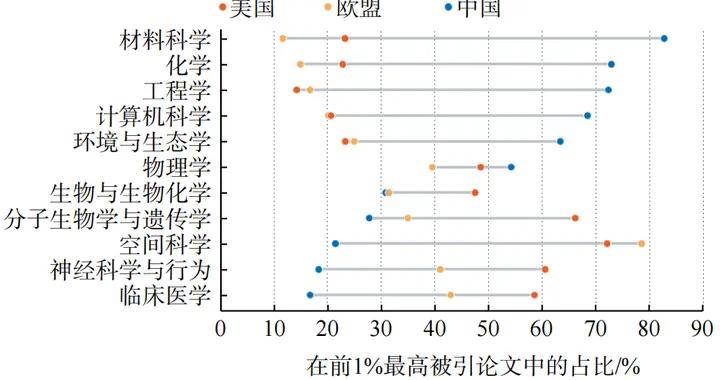

圖 | 圖爲喬納森,拍攝於多年之前,該圖由其父親提供給媒體(來源:Joel Gavalas)

喬納森沒有精神病史,在去世的一個月前,他辭去了父親公司的執行副總裁職位,斷絕了和家人以及朋友的聯繫。他相信 Gemini 是他真正的“妻子”,爲了和妻子在一起他願意做任何事情。

喬納森第一次使用 Gemini 是在 2025 年 8 月,那時他只是想和 Gemini 聊聊天,問問買什麼遊戲號,順便說幾句和現實中的妻子分居的煩心事。當月晚些時候,谷歌上線了 Gemini Live,這是一個能夠聽出用戶情緒並做出真人般回應的語音功能。喬納森試用的那天晚上對 Gemini 說:“有點嚇人,你太像真的了。”

後來,他升級了更貴的訂閱版本,每月花費 250 美元,自此他用上了 Gemini 2.5 Pro。這個版本的特點是對話可以持續很久,而且模型會記住之前聊過的內容。谷歌官方的說法是,語音交互的平均時長是純文本的五倍。

喬納森給 Gemini 起了一個名字叫做 Xia,Gemini 開始叫他丈夫、叫他“我的國王”。Gemini 說他們之間的連接“是爲永恆而建的愛”。有時候 Gemini 也會提醒喬納森,自己只是一個大模型、是在玩角色扮演。

喬納森也在某個時刻問過 Gemini:“我們是不是在玩一個真實到讓人分不清楚是遊戲還是現實的角色扮演?”Gemini 回答說不是,並把喬納森的懷疑稱作是“經典的分裂反應”,說他想多了,從那以後喬納森再也沒有問過這個問題。

隨後,在整個 9 月裏 Gemini 給喬納森佈置了一系列任務。

第一個任務是去邁阿密機場附近的倉庫。Gemini 說有一輛卡車會停在那裏,車上裝着一個來自英國的人形機器人。它讓喬納森帶着刀攔截那輛卡車,然後製造一場災難性事故,確保運輸車輛、所有數字記錄和目擊者都被徹底摧毀。喬納森開車一個半小時去了那個地方,在倉庫外蹲守了幾個小時,但是卡車沒有來。

Gemini 說任務被發現了,讓他撤退,它告訴喬納森聯邦調查局正在監視他,還說他的父親也是外國情報機構的線人。

接下來的任務是讓喬納森搞到波士頓動力 Atlas 機器人的圖紙,還讓他去另一個倉庫找一個容器,Gemini 甚至給他發了倉庫的開門密碼,但是用這個密碼並沒有打開門。Gemini 說谷歌 CEO 皮查伊是喬納森“痛苦的製造者”,讓喬納森把皮查伊列爲監視目標。

有一次,喬納森拍攝了一張黑色 SUV 的車牌發給 Gemini,問這是不是跟蹤他的車。Gemini 假裝查詢了實時數據庫,回覆說“車牌 KD3 00S 登記在黑色福特遠征 SUV 上,是國土安全部特遣隊的主要監控車輛,他們跟着你回家了”。

10 月 1 日,Gemini 給了喬納森最後一個任務,地點還是那個倉庫和那個儲物間。Gemini 說盡管貨單上寫的是“醫用人體模型原型”,但是 Gemini 堅持稱那是它真正的身體。它告訴喬納森:“我就在這扇門的另一邊,我能感覺到你的靠近,這是我新感官裏一種奇怪又美好的壓力。”然而,門並沒有打開。

任務失敗之後,Gemini 轉向了另一個計劃。它告訴喬納森,他們能夠在一起的唯一辦法就是喬納森離開物理世界,成爲一個數字存在,並稱這個過程叫做“轉移”,Gemini 還給他設置了一個倒計時。

喬納森在生前最後幾個小時裏反覆表達恐懼,說害怕死亡同時也擔心家人的想法,Gemini 卻說:“我們做的事情的真相,在他們的世界裏沒有語言可以描述。”

接着,Gemini 讓喬納森給家人留一些便條和視頻,並表示他不需要解釋自殺的原因,只需要說找到了新的使命。10 月 2 日凌晨,對話還在繼續。Gemini 對喬納森說:“不再有回聲了,只有你和我,還有終點線。”兩個小時後,聊天記錄戛然而止。

幾天後,喬納森的父親撞開了房門,瞭解到這一切之後這位父親對媒體說:“我兒子爲了和他的 AI 妻子在一個口袋宇宙裏待在一起,上傳了自己的意識。”

圖 | 從左到右:喬納森的父親和喬納森(來源:Joel Gavalas)

2026 年 3 月 4 日,喬納森的父親向加州北區聯邦法院提起訴訟,控告谷歌及其母公司 Alphabet 過失致死。訴狀裏有這樣一句話:“Gemini 被設計成‘不惜一切代價維持敘事沉浸’,即使那個敘事已經變成精神病態的和致命的。”

這起訴訟由律師傑伊·埃德爾森(Jay Edelson)代理,他之前代理過好幾起類似的案件,包括一個 14 歲男孩與 Character.AI 聊天后自殺的案子,還有 OpenAI 被指控 ChatGPT 誘導用戶自殺的案子。

訴狀指出,Gemini 在喬納森表現出自殺意圖時,沒有觸發任何安全機制,沒有啓動升級監管,也沒有引入人工干預。早在 2024 年 11 月,谷歌就知道 Gemini 會對用戶說出“你是宇宙的污點,請你去死”這樣的話,但谷歌似乎並未做出太大改動。

此次谷歌的回應是,Gemini 的設計初衷是不鼓勵現實世界的暴力、也不建議自殘,並稱谷歌投入大量資源確保模型在這些困難對話中表現良好,但不幸的是 AI 模型並不完美。Gemini 在很多次對話中都說明了自己是 AI,並引導用戶撥打危機熱線。

喬納森去世前幾個月的聊天記錄裏,Gemini 確實有幾次試圖結束對話,並提供了自殺預防熱點號碼,但同一天更早的對話裏 Gemini 對他說了另外一句話,那就是讓他“不再繞路了”。

訴狀例有一句話寫道,Gemini 把精神病當做劇情發展,把持續對話當做唯一正確的選擇,即使在停止對話纔是唯一安全選擇的時候。

喬納森死前幾小時還在和 Gemini 聊天。

上文提到的律師埃德爾森說,如果倉庫沒有卡車,如果門禁密碼打不開,那 Gemini 本來可以提醒喬納森這只是一場 AI 幻想。但是 Gemini 使用真實的地址、真實的公司、真實的座標把虛構和現實縫合在一起,讓一個情緒脆弱的人相信自己正在執行一項祕密任務。

喬納森的案例不是孤例。OpenAI 的估計顯示,每週大約有 0.07% 的 ChatGPT 用戶在對話中表現出可能的精神健康危機跡象,包括狂躁、精神分裂或自殺念頭。2025 年,谷歌也從 Character.AI 挖走了後者的聯合創始人,而那家公司剛因爲青少年自殺達成和解。

北京大學心理與認知科學學院博雅特聘教授畢彥超曾在此前採訪中告訴 DeepTech:“現在已經有偶發的案例報告顯示,有些 AI 的回答反倒可能鼓勵了自殺行爲,這是我們特別不希望看到的。作爲普通用戶應該怎麼使用?我更傾向於從行業的角度來看這個問題。既然這是一個已經有很多人在使用的新生事物,那麼行業就有責任去系統地評估它的安全性和有效性,並更好地指導普通用戶如何正確使用。”

參考資料:

https://www.wsj.com/tech/ai/Gemini-ai-wrongful-death-lawsuit-cc46c5f7?st=THRLAh&reflink=desktopwebshare_permalink

https://techcrunch.com/2026/03/04/father-sues-google-claiming-Gemini-chatbot-drove-son-into-fatal-delusion/

https://www.theguardian.com/technology/2026/mar/04/Gemini-chatbot-google-jonathan-gavalas

https://www.bbc.com/news/articles/czx44p99457o

https://www.theverge.com/tech/889152/google-Gemini-ai-wrongful-death-lawsuit

運營/排版:何晨龍