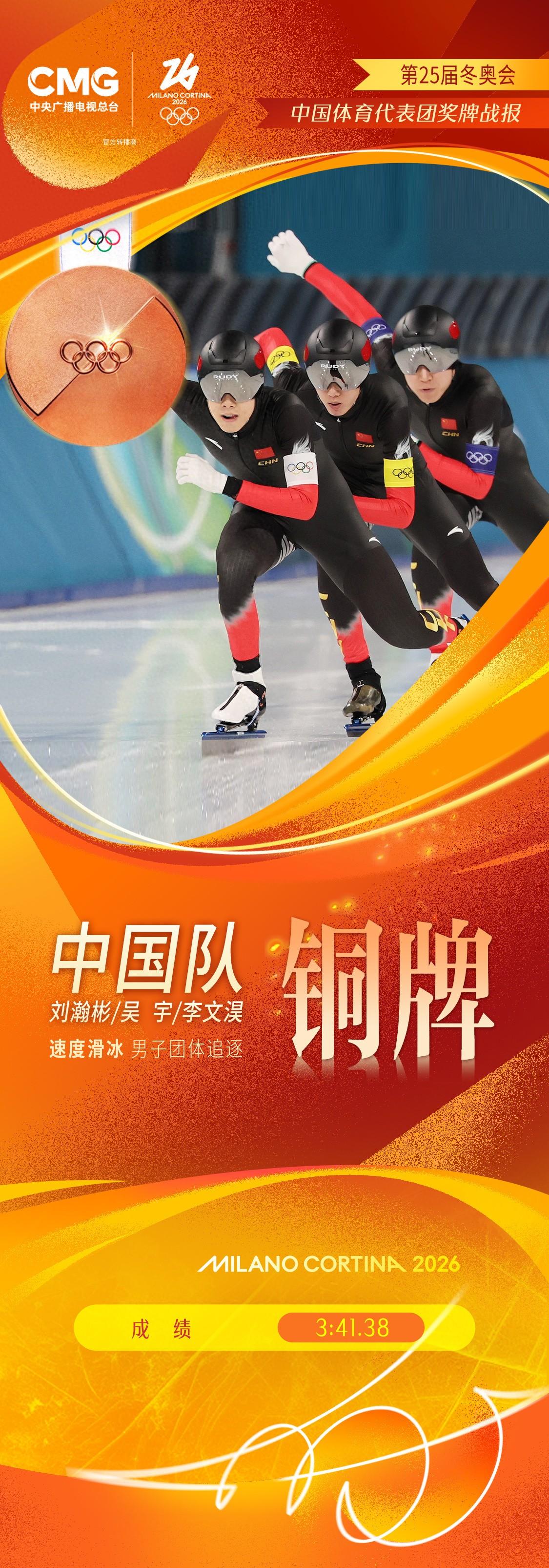

馬年春晚,人形機器人首次大規模登上舞臺,留下的名場面足夠吸睛:

二十多臺機器人在聚光燈下完成Airflare大回旋七週半;

仿生機器人以1:1比例復刻蔡明的面部表情,連挑眉的細節都能同步;

輪式雙臂機器人在複雜環境中自主完成撿玻璃、疊衣服等精細操作;

還有的機器人能翻桌跑酷,或是“醉倒”後迅速起身……

圖源 / 春晚微博截圖

熱鬧亮相的背後,是四家公司不惜砸重金爭奪入場券的激烈較量。松延動力、宇樹科技、魔法原子、銀河通用雖同爲合作方,官方稱謂卻各有講究:宇樹是“春晚機器人合作伙伴”,松延動力爲“春晚人形機器人合作伙伴”,魔法原子是“春晚智能機器人戰略合作伙伴”,銀河通用則稱“春晚指定具身大模型機器人”。

名頭的細微差別,背後對應的正是四家公司不同的技術路線與戰略側重:有人強調運動控制,有人突出仿生交互,有人主打系統集成能力,也有人押注具身大模型。

然而,當春晚落幕,越來越多人也開始思考,春晚本質上是一次高規格的“演示工程”,可以反覆彩排,追求的是一次性的完美呈現,舞臺成功不等於場景落地。在這場耗資不菲的高曝光豪賭中,贏得流量幾乎是確定的,但機器人從“春晚舞臺”走向“千家萬戶”,還有多遠?

01 扎堆上春晚,四家機器人表現如何?

2026年馬年春晚,宇樹科技、銀河通用、松延動力、魔法原子通過武術、仿生、對話與精細操作等多種形式集體登臺,如此密集且高水準的亮相,讓觀衆不禁感慨人形機器人的迭代速度,僅僅一年,就從需要攙扶上臺的青澀表現,進化到能自主玩梗、連續空翻的全新階段。

松延動力最先在第一個小品類節目《奶奶的最愛》中登場,旗下機器人N2、E1與小布米各大型號全部搬到臺上,演示了走路跑步、講冷笑話玩梗等多種技能,小布米走路姿勢貼近於人類,N2更是能輕鬆完成墊步側手翻,擬人化的動作與人機交互十分引人注目。

圖源 / 春晚微博截圖

但更具話題性的,是其研發的蔡明同款仿生機器人。該機器人以1:1比例真實復刻蔡明的外形,更厲害的是“臉上”藏着32組微型馬達,能精準模仿她挑眉、皺眉等細微表情,連脖子轉動都配合着呼吸的節奏,整體呈現出接近真人的狀態。這也意味着人形機器人在“面部模仿”這條賽道上,又向前邁進了一步。

魔法原子“戲份”最多。在主會場上,六臺人形機器人MagicBot Z1和兩臺MagicBot Gen1與易烊千璽、言承旭等藝人同臺演繹《智造未來》。在宜賓分會場中,還有上百臺四足機器人MagicDog以“大熊貓”造型完成大型羣控表演。

同時還有實用性展示,MagicBot Gen1化身“撈麪師”,完成起面、控水、倒面等連貫操作,併爲老人斟酒;而MagicBot Z1則配合以“送餐員”身份將宜賓燃面送達指定位置。

整場晚會充分展現了魔法原子機器人的綜合實力:它們既能完成整齊劃一的大型編隊表演,也能執行撈麪、斟酒等生活化操作,更能靈活適應舞臺、餐廳等多種場景,實現與人和環境的自然、順暢互動。

宇樹科技則是標準的動作型選手。在武術節目《武BOT》中,其機器人完成了連續翻桌跑酷、彈射空翻等一系列高難度動作,更在全球首次實現了Airflare大回旋七週半,動作流暢穩定,被贊“超越真人”。

值得關注的還有羣體協同,二十多臺機器人在舞臺上實現了高速奔跑中的實時變陣與協同武術,其動態協調能力較去年僅能慢速轉手絹調整隊形有了質的飛躍。

在人機互動環節,通過加裝一雙靈活的“機械手”,它能穩穩接住並旋轉長棍,更在劇情安排下完成“醉倒”後迅速起身的鯉魚打挺動作。這些設計不僅增添了表演的趣味性,更直觀展現了機器人在失去平衡時快速自我調整的能力,讓人看到它正朝着更實用、更智能的方向邁進。

與宇樹側重極限運動性能不同,銀河通用在其賀歲微電影《我最難忘的今宵》中,重點呈現了機器人在認知與操作層面的“大小腦”能力。

其輪式雙臂機器人G1展示了多項貼近生活的技能,如盤核桃、撿玻璃碎片、疊衣服、貨架取物和簡單烹飪,動作流暢自然。

更重要的是,根據官方介紹,它並不是完全按提前編好的程序一步步執行,而是能自己觀察周圍、思考判斷,再完成整個任務。這意味着它在雜亂的真實環境裏,也能獨立應對,做出精細的操作。在與演員沈騰、馬麗的互動中,它的反應也比較自然,能及時察覺周圍的變化並做出回應。

總體來看,2026年春晚像是國產機器人行業的一次集中交卷,從松延動力的仿生情感交互,到魔法原子的多場景實用能力,再到宇樹科技的極限運動與集羣協同,以及銀河通用的自主決策與精細操作,讓人們看到了機器人技術通過不同路徑,正在探索如何更深入地服務於現實生活。

02 表演背後,誰更技高一籌?

當精彩的機器人表演伴隨春晚落幕,一個更值得深思的問題也隨之而來,讓機器人完成一段預設舞蹈、進行一場即興對話,或是完成一項精細的實體操作,其背後的技術挑戰與實現路徑究竟有何不同?誰的技術門檻更高?

與大衆直觀感受存在明顯差異的是,從技術實現角度來看,讓機器人“自然對話、即興玩梗、撈麪、倒酒”的含金量並不一定比表演“具備視覺衝擊力的預設舞蹈動作”低。

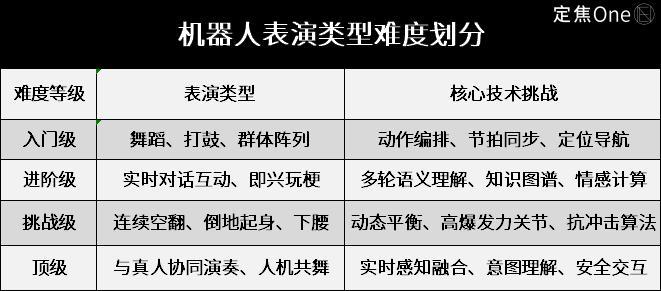

綜合多位從業者的說法,機器人表演的技術難度可以分爲四個等級。

第一層是入門級。北京大學計算機學院訪問工程師、在機器人行業擁有豐富實踐經驗的gashero進一步解釋,入門級類似於過去50年機器人一直在乾的老本行,按順序做動作、找準自己的位置,這些技術已經很成熟了,現在室內定位甚至能精確到釐米級別。

第二層是進階級,是多模態大模型興起之後,才讓機器人開始變得現實的能力,集中體現在對話上。

資深具身智能從業者Kris告訴「定焦One」,機器人能夠對話玩梗,主要依託於大模型能力的進步,類似豆包這類應用已進入C端普及階段,現階段實現這類功能難度並不大,但目前瓶頸在於泛化能力不足,即面對超出訓練場景的突發狀況,機器人往往難以靈活應對。

因此有從業者指出,松延動力機器人在小品中的展示的玩梗對話,很可能是預設腳本與實時交互技術的結合。一方面,要考慮到春晚舞臺的複雜性和對錶演穩定性的嚴苛要求,因此關鍵臺詞、互動流程等核心環節大概率經過了預先編排,另一方面,依託大模型的實時推理能力,機器人也能在一定程度上根據現場演員的即興發揮做出動態回應。

第三層是挑戰級,難度雖然也體現在舞蹈動作上,但和初級不同的是,它屬於連續空翻這類對軟硬件綜合能力提出更高要求的動作,宇樹科技在本次表演中呈現的連續多次後空翻就數此類。Kris表示,目前市面上能達標的機器人並不多,許多產品在運行中仍容易出現“趴窩”的情況。

至於最高層級的頂級難度,則集中在人機深度交互上。這要求機器人不僅能感知環境,還需理解人的意圖並作出安全、恰當的反應。

比如,松延動力的機器人能識別並同步蔡明的微表情,完成情感層面的交互;銀河通用的G1能精準定位並拾取細碎的玻璃片,體現了對物理世界的精細操作能力;而宇樹科技在《武BOT》中設計的“醉倒”後鯉魚打挺橋段,表面是戲劇效果,實則演示了機器人在失控狀態下快速恢復平衡、避免碰撞人類的安全兜底能力。“目前在人機交互中,能做到共舞協調不踩腳就已經非常不容易了。”gashero表示。

不過,現階段人形機器人距離真正“讀懂”周圍環境,和真人配合流暢還存在很大差距。

需要注意的是,在評判這些技術演示的實際水平時,另一個常被忽視卻至關重要的維度是實現場景的可靠性。比如機器人能否在不可逆的現場直播中穩定發揮,是對技術成熟度的嚴苛要求。一次成功的演示,並不等同於長期可復現的能力。

本次春晚中,銀河通用選擇以微電影形式呈現其機器人的自主操作能力,這在一定程度上規避了直播對系統實時性與穩定性的極端挑戰,也讓觀衆得以看到在多次嘗試後選取的“最優表現”。這種呈現方式本身,也一定程度上反映出當前技術從實驗室、受控場景走向真正複雜現實環境時,所普遍面臨的門檻。

總之,本次春晚各大機器人公司秀出了不同的看家本領:有的專攻極致控制,有的挑戰智能交互,有的則致力於複雜環境適應,體現了行業不同的技術路徑與積累。在從業者看來,無論呈現形式是直播還是錄播,這些機器人能按預設動作順利完成表演,已經達到了他們對行業現階段能力的合理預期。

03 春晚之後,離實用還有多遠?

市場關注的另一大焦點在於,當機器人離開春晚這一精心設計的舞臺後,它們能否在現實世界穩定工作。畢竟春晚更像是一次“演示”,強調單次表現的確定性和觀賞性,無法完全等同於複雜場景下的實際落地能力。

不止一位從業者對「定焦One」表示,機器人在春晚上的舞蹈、翻跟頭等表演,並不能直接等同於其在複雜環境下的真實作業能力,但已十分接近真實工業與生活場景對運動控制的要求,因此這部分“底盤能力”已經相對成熟。

gashero解釋,春晚的環境對機器人而言,其複雜程度並不亞於工業場景。

“現場燈光變化複雜,對計算機視覺干擾極大。電磁干擾雖未必達到工廠級別,但也相當顯著,可能影響機器人的通信與定位。”因此,在這種複雜環境下仍然能穩定完成動作,說明其硬件可靠性與基礎控制算法已較爲成熟。

他以翻跟頭這一舞蹈動作舉例,這類動作反映的是機器人在複雜環境中降低失誤的能力和出色的平衡控制。這就相當於爲將來機器人能進入養老等場景,執行協助老人翻身、更衣等對平衡能力提出高要求的任務,做出了技術保障。

需要注意的是,儘管機器人在春晚上的表現值得肯定,但離真正落地還有很長一段路要走,前者(翻跟頭等舞蹈能力)是後者(落地服務能力)的必要非充分條件。他強調,機器人還需要具備更復雜的“感知–認知–行動”的閉環與長期自主運行能力。

綜合從業者的觀點,人形機器人要真正走進生活與生產場景,至少還面臨四方面挑戰。

首先是泛化能力,要具有舉一反三的靈活性。

機器人在春晚中的每一個動作都經過反覆彩排、精確到毫秒,但真實場景充滿不確定性。當你對家用機器人說“把房間收拾一下”,它面臨的遠非單一指令,而是一個開放命題:這個家庭的“整潔”標準是什麼?散落的書該放回書架還是疊在桌角?髒衣服要放進洗衣籃還是直接啓動洗衣機?機器人必須基於對物品功能、空間關係和家庭習慣的理解,自主拆解任務、動態決策,而非調用預設程序。

圖源 / 春晚微博截圖

其次是持續的自主性。

春晚表演通常是幾分鐘的高強度輸出,機器人在聚光燈下耗盡算力與能量,完成完美展示後即可關機檢修。但在家庭或工業場景中,需要的是7×24小時×365天的連續運行,這要求機器人具備較強自主性,包含能耗的動態平衡、故障的實時自診斷、關鍵部件的預測性維護,甚至在極端情況下自主決策是暫停任務還是繼續執行。

第三是真實的情境理解與交互。

春晚舞臺上的“情感表達”本質是預設的表情包與動作庫,比如微笑、眨眼、揮手等,而想要落地到家庭場景中,需要機器人具備自身的情感計算能力,比如能識別老人微表情背後的孤獨或焦慮,或者在重複對話中保持耐心,這種需要通過長期陪伴建立信任關係、甚至提供心理支持的能力,無法調用預設腳本。

Kris總結,當前最根本的技術侷限在於,大模型仍處於對模式的模仿與概率計算階段,而非真正理解世界並形成常識認知。如何讓機器人擁有接近人類的理解與判斷能力,而不僅僅是執行預設或統計意義上最可能的回應,是其“大腦”進化過程中最艱鉅的課題。gashero也認爲,想讓機器人承擔更多有意義的工作,目前核心是持續提升其“大腦”能力,包括環境理解、危險預判、複雜動作規劃等方面。

最後,成本也是一道重要難題。雖然機器人開始進入量產階段,但依舊昂貴,當前人形機器人單機成本普遍超10萬,春晚定製產品更是“不計成本”,因此很難複製到商業化場景中。對企業客戶而言,高昂的採購成本與不確定的回報形成鮮明反差,直接制約着機器人行業的落地速度。

這次春晚的“官方背書”,確實提升了機器人行業的熱度,曝光度大增。但熱鬧背後,“表演有餘、實用不足”仍是行業的痛點,雖然機器人技術迭代速度很快,但從炫技到真正進入日常生活,還有很長的一段路要走。

本文來自微信公衆號 “定焦”(ID:dingjiaoone),作者:定焦One團隊,36氪經授權發佈。