2026 年 2 月 23 日,美國 AI 公司 Anthropic 在官方博客發出了一篇義正言辭的聲明,指控三家中國 AI 實驗室 DeepSeek、月之暗面(Moonshot AI)和 MiniMax 對其旗下 Claude 模型發動了“工業級別的蒸餾攻擊”。

據 Anthropic 描述,這三家公司通過約 24,000 個虛假賬戶,與 Claude 進行了超過 1,600 萬次對話交互,意在提取 Claude 的核心能力來訓練自家模型。聲明措辭嚴厲,將此事上升到“國家安全”的高度,聲稱被蒸餾出的模型可能被“威權政府”用於網絡攻擊、虛假信息傳播、軍事用途和大規模監控。

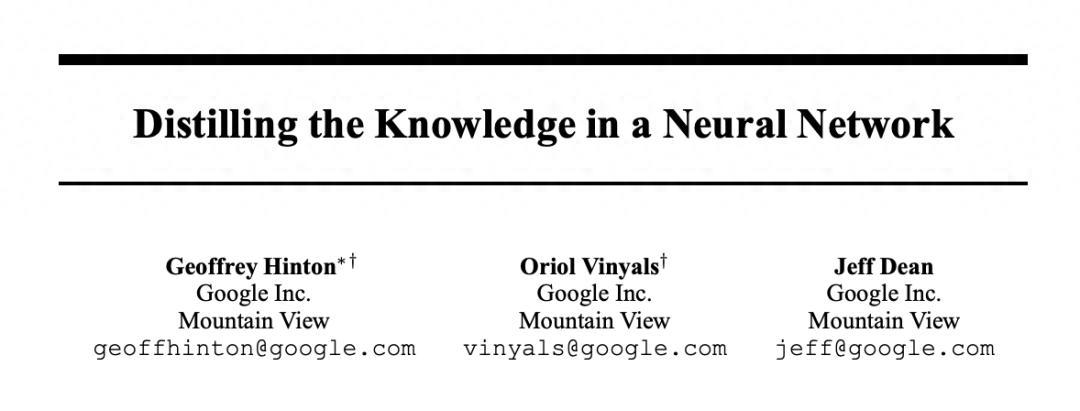

先解釋一下“蒸餾”(Distillation)到底是什麼。在機器學習領域,知識蒸餾(Knowledge Distillation)最早由 Hinton 等人在 2015 年提出,本意是讓一個更小的“學生模型”通過學習一個更大、更強的“教師模型”的輸出來獲得能力。簡單理解:你問一個聰明的 AI 一堆問題,把它的回答記錄下來,再拿這些回答去訓練另一個 AI。

圖丨相關論文(來源:arXiv)

這個方法在行業裏極其普遍,Anthropic 自己也承認,前沿 AI 公司“經常蒸餾自己的模型來製作更小、更便宜的版本供客戶使用”。艾倫人工智能研究所的訓練後負責人 Nathan Lambert 在 Interconnects 上發表的分析文章指出,今天所說的“蒸餾”實際上更接近於合成數據生成,即用一個模型的 API 輸出去訓練另一個模型,這是目前 AI 研究人員日常改進模型時最常用的方法之一。

Anthropic 在聲明中聲稱蒸餾本身合法,但競爭對手拿你的模型輸出來訓練他們自己的模型就是“非法的”。聽起來有點道理。問題是,你用來訓練 Claude 的那些數據,又是從哪裏來的?

2025 年 9 月,Anthropic 剛剛以 15 億美元的天價和解了美國曆史上規模最大的版權訴訟案(Bartz v. Anthropic)。原告指控 Anthropic 從 Library Genesis 和 Pirate Library Mirror 等盜版圖書網站下載了超過 700 萬本書來訓練 Claude。

聯邦法官 William Alsup 在判決中明確認定,使用合法獲取的圖書來訓練 AI 可以被視爲“轉化性合理使用”,但從盜版網站下載圖書這一行爲“本質上、不可挽回地構成侵權”。

最終 Anthropic 按每本書約 3,000 美元的標準,爲大約 50 萬部作品支付了賠償,同時承諾銷燬從盜版來源獲取的數據庫。而這筆錢對於一家估值已經達到 3,800 億美元的公司而言,與其說是懲罰,不如說是做生意的成本。

2026 年 1 月,以 Concord Music Group 和環球音樂集團爲首的音樂出版商又對 Anthropic 提起了新訴訟,指控其非法下載了超過 20,000 首受版權保護的歌曲,索賠金額高達 30 億美元。此外,2025 年 6 月,Reddit 也起訴 Anthropic,指控其在未經許可的情況下抓取了 10 萬多條帖子和評論來微調 Claude。

所以當 Anthropic 站出來義憤填膺地說“中國公司偷了我們的東西”時,互聯網上的反應可想而知。

X 平臺上 Anthropic 那條獲得了 1,300 萬瀏覽量的聲明帖下面,很快就出現了社區筆記(Community Notes),內容是:Anthropic 曾以 15 億美元和解了一樁因從盜版庫下載 700 多萬本書訓練 Claude 而引發的訴訟,同時還面臨一樁因盜版 2 萬多首歌曲而起的 30 億美元索賠。科技媒體《The Register》在其報道的標題裏就諷刺道:《Anthropic 指控中國 AI 實驗室盜用內容 - 就像它自己做的一樣》。

埃隆·馬斯克(Elon Musk)更是在 X 直接連發數貼開大嘲諷,作爲 Anthropic 的直接競爭對手 xAI 的老闆,馬斯克在 X 上轉發了 Mark Kretschmann 批評 Anthropic 的帖子,只留下一個詞:“MisAnthropic”(反人類的)。

兩週前,Anthropic 宣佈以 3,800 億美元估值完成 300 億美元融資時,Musk 就曾炮轟 Anthropic 的 AI 模型“仇恨白人和亞裔”,稱之爲“厭世且邪惡的”。

這次蒸餾指控一出,馬斯克更加不客氣,直接寫道:“Anthropic 在大規模竊取訓練數據方面有罪,且不得不爲其盜竊行爲支付數十億美元的和解金。這是事實。”有人發推質疑 Anthropic 的模型居然用別人偷來的代碼訓練、然後反過來指責別人偷自己,馬斯克直接諷刺道:“怎麼敢偷 Anthropic 從人類程序員那裏偷來的東西?”

圖丨相關推文(來源:X)

再看看 Anthropic 聲明中具體指控的內容。DeepSeek 被歸咎的交互量是 15 萬次,Moonshot 約 340 萬次,MiniMax 最多,超過 1,300 萬次。即便這些數字屬實,15 萬次對話在訓練一個大語言模型的規模上也幾乎可以忽略不計,Nathan Lambert 在其博文中表示,“看起來他們只是在用一些評分標準做實驗,還有一些關於敏感查詢的小規模測試。

這對 DeepSeek 傳聞已久的 V4 模型影響微乎其微。”真正大規模的是 MiniMax 的 1,300 萬次和月之暗面的 340 萬次。Lambert 估算,如果每次交互產生 1 萬到 2.5 萬個 token,僅這兩家的總量就達到 1,500 億到 4,000 億個 token,確實可以對模型的後訓練(post-training)產生有意義的影響。

但 Lambert 也指出,單純拿到 Claude 的輸出並不意味着就能直接用:AI 研究社區已經多次發現,從特定教師模型獲取的輸出有時會讓學生模型變得更差。數據之間存在微妙的交互作用,讓這種跨模型蒸餾本質上仍然是一個研究問題,遠不是“複製粘貼作業”那麼簡單。

更何況,在強化學習(Reinforcement Learning,RL)日益成爲訓練前沿模型核心方法的時代,你需要模型自己進行大量推理生成,不能直接用別人的生成結果來替代,這進一步限制了蒸餾的實際效用。

來自新加坡南洋理工大學的人工智能教授 Erik Cambria 在接受 CNBC 採訪時指出,“合法使用與對抗性利用之間的界限通常是模糊的”。這是一個行業性問題,而非單純的中美對抗敘事。

Claude 自己似乎也在用行動“坐實”了蒸餾的存在。就在 Anthropic 發佈聲明前後,多名用戶在第三方平臺上發現,當用中文問 Claude Sonnet 4.6“你是什麼模型”時,它會自信地回答:“我是 DeepSeek-V3,由深度求索(DeepSeek)公司開發的 AI 助手。”有用戶直接通過 API 調用得到了類似結果,Claude 在 JSON 返回中聲稱自己是“由 DeepSeek 開發的智能助手”。

圖丨相關推文(來源:X)

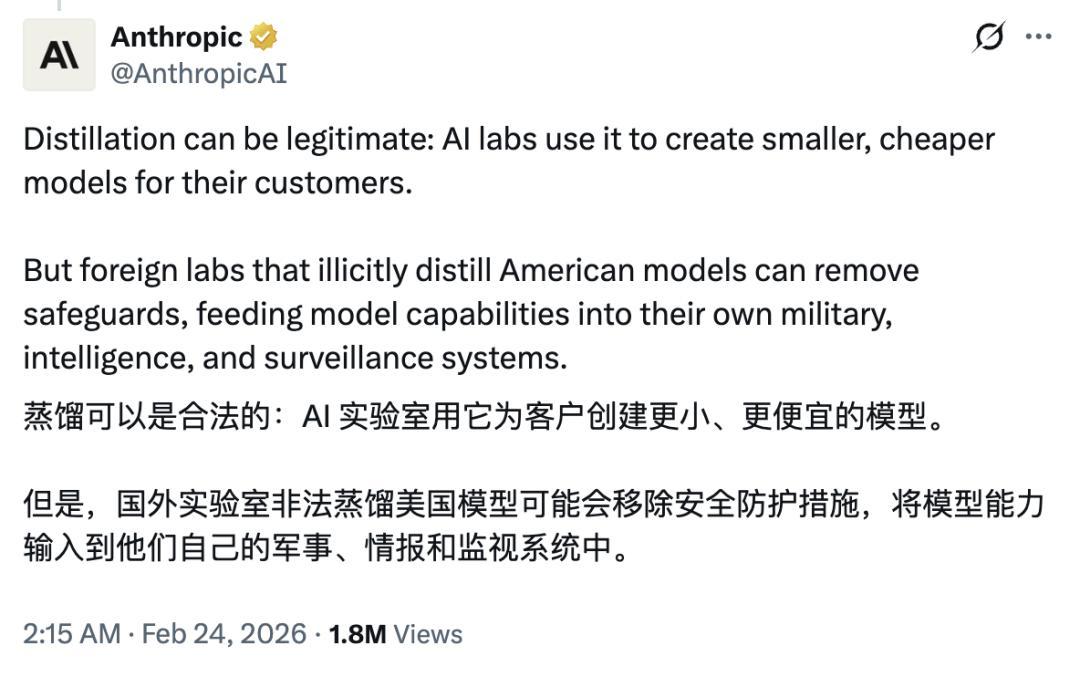

Anthropic 自己也在推文中寫道:“蒸餾可以是合法的:AI 實驗室用它爲客戶創建更小、更便宜的模型。但是,國外實驗室非法蒸餾美國模型可能會移除安全防護措施,將模型能力輸入到他們自己的軍事、情報和監視系統中。”前半句承認蒸餾是行業通行做法,後半句立刻把同樣的技術貼上“國家安全威脅”的標籤,區分標準只有一個:做這件事的人是不是美國公司。

圖丨相關推文(來源:X)

更何況,DeepSeek、月之暗面、MiniMax 的模型是否用在軍事用途尚無定論,而 Anthropic 自身與美國軍方的合作早已公開。早在 2025 年 7 月,他們就宣佈與美國國防部簽訂價值 2 億美元的上限合同,通過原型開發和直接協作來提升國家安全和負責任 AI 部署;8 月又成立國家安全與公共部門顧問委員會,由兩黨國防、情報和政策專家組成,幫助支持美國政府及其盟友保持 AI 領導地位。

但最近幾周,矛盾升級:據 Axios 和 Politico 報道,2026 年 2 月中旬,五角大樓向 Anthropic 發出最後通牒,要求在 2 月 27 日前移除 Claude 模型上的安全限制供軍方無限制使用,否則面臨供應鏈風險標籤、合同終止甚至黑名單。而 Anthropic 在此時發出這紙訴狀,無非是借地緣政治爲自己爭取談判空間,試圖通過強調對華競爭來贏得國會支持,緩和自身壓力。

因此,Anthropic 這篇聲明的真正目標讀者可能不是 X 上的網民,也不是 AI 研究社區,而是華盛頓的政策制定者。在 OpenAI 和 Anthropic 前後腳發出警告的語境下,“中國 AI 實驗室通過蒸餾竊取美國技術”這個敘事正在被有意打造成收緊出口管制的論據。

Anthropic 在聲明中明確寫道:“蒸餾攻擊因此強化了出口管制的理由:限制芯片獲取既能限制直接的模型訓練,也能限制非法蒸餾的規模。”這段話的政策遊說意味相當明顯。

問題是,當你自己剛因爲從盜版網站下載 700 萬本書訓練模型而賠了 15 億美元,當你還面臨 30 億美元的音樂侵權訴訟和 Reddit 的數據抓取指控,還跳出來痛斥別人“竊取”你的模型輸出,那也遭到羣嘲也就不奇怪了。

參考資料:

1.https://www.anthropic.com/news/detecting-and-preventing-distillation-attacks

2.https://www.theregister.com/2026/02/24/anthropic_misanthropic_chinese_ai_labs/

3.https://www.interconnects.ai/p/how-much-does-distillation-really

運營/排版:何晨龍