2026 年的前兩個月,開源大模型的發佈節奏已快至令人應接不暇。Arcee AI 的 Trinity Large、月之暗面的 Kimi K2.5、阿里的 Qwen3.5、智譜 AI 的 GLM-5、Cohere 的 Tiny Aya……它們的名稱如流水般接踵而至,參數量從 3B 至 1T 不等,每一款都宣稱是“SOTA”或者“最強開源”。

然而,如此快的更新速度,對於普通開發者而言,莫說深入研究,僅僅是分辨區別就已經耗費大量精力。更不用提許多技術報告的表述含糊,架構圖繪製風格各異,想要進行橫向對比十分困難。

爲了解決這些問題,一個名爲“LLM Architecture Gallery”(大語言模型架構畫廊)的項目上線了。顧名思義,就是讓你像逛“畫廊”一樣,瀏覽不同模型的架構圖。

(來源:X)

這個項目的作者是 Sebastian Raschka,是機器學習領域的知名研究者,寫過《Python Machine Learning》和《Build a Large Language Model (From Scratch)》這兩本深受歡迎的專業書籍。

(來源:Sebastian Raschka.com)

他把過去幾個月撰寫的兩篇長文《The Big LLM Architecture Comparison》和《A Dream of Spring for Open-Weight LLMs》中繪製的所有架構圖抽取出來,用統一的視覺語言重新呈現,集中放在一個頁面上。點擊任意一張圖可以放大,每張圖下方附帶一份“規格表”,列出模型的參數量、發佈時間、注意力機制類型等關鍵信息。想深入某個模型,可以點開“view in article”頁面會直接跳轉到原文對應章節。

(來源:LLM Architecture Gallery)

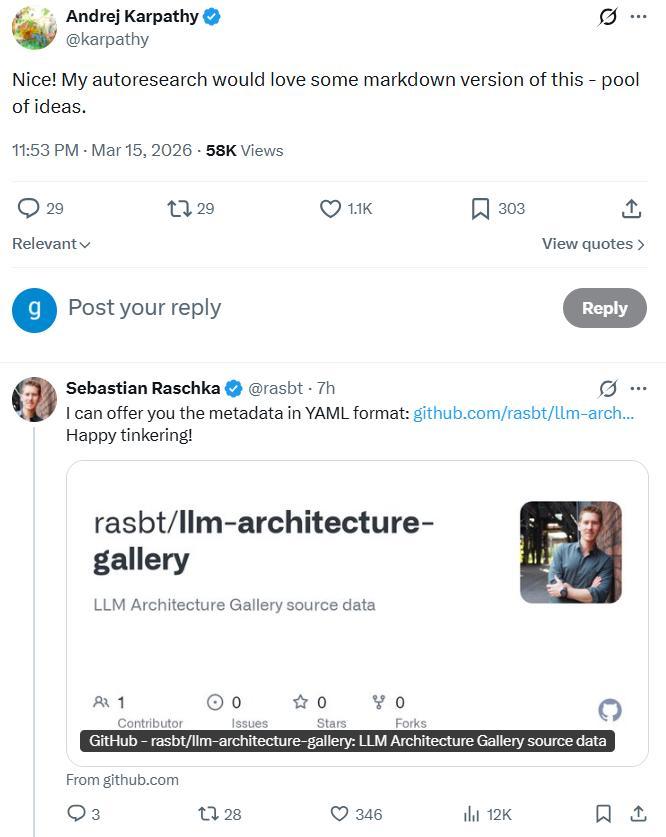

項目上線幾小時後,Andrej Karpathy 在 X 上回復了 Raschka 的推文:“太好了!我的自動研究功能很需要這個內容的 Markdown 版本——一個創意池。”他最近發佈的 autoresearch 項目:一個讓 AI 自主跑實驗的開源工具,正需要這類結構化的架構信息作爲創意來源。

Raschka 也很快作出回覆,並提供了 YAML 格式的元數據 GitHub 鏈接。Karpathy 隨後表示他已經用 Obsidian 把博客文章導出成 markdown,並且“輸入到了 autoresearch 循環中”。一個本意是方便人類閱讀的架構圖集,就這樣被接入了 AI 自動化研究的工作流。

(來源;X)

就在今天,這個項目也衝上了 Hacker News 首頁。一位用戶評論說:“這讓我想起了當年的 Neural Network Zoo,也是用可視化的方式展示不同架構。”也有人繼續幫忙優化細節:“能不能按時間排序,畫出架構演化的家譜樹?能不能加一個比例視圖,讓參數量的差異在視覺上直觀可感?”對於這些建議,Sebastian 表示他後續會持續完善。

回到項目本身,目前,這份圖集收錄了三十多個模型架構,從 Llama 38B 到最新的 Qwen3.5、Sarvam 105B、Ling 2.5 1T。所有圖都按同一套視覺規範繪製:配色、圖例、字體統一,DeepSeek V3 和 Qwen3 235B-A22B 被放在一起時,你一眼就能看出前者用了 MLA(Multi-Head Latent Attention,多頭潛在注意力),後者用的是 GQA(Grouped-Query Attention,分組查詢注意力);DeepSeek V3 有一個“共享專家”模塊,Qwen3 沒有。

這類信息原本散落在幾十頁技術報告的不同角落,現在被壓縮成一張對比圖。

MoE(Mixture-of-Experts,混合專家模型)是 2025 年開源 LLM 的主旋律。所有主流的前沿開放權重模型都採用了這種架構。傳統的“稠密”Transformer 會在每次生成 token 時激活全部參數,參數越多,算力成本越高。而 MoE 把參數分成若干“專家”,每次只激活其中一部分。DeepSeek V3 名義上有 6,710 億參數,但實際運行時只激活 370 億;Llama 4 Maverick 號稱 4,000 億參數,激活的只有 170 億。

Raschka 在圖集中把各模型的專家數量、激活比例、專家隱藏層尺寸都標註出來,讓稀疏程度一目瞭然。Hacker News 上有人感慨:“我很驚訝這些模型在結構上有多相似,主要差異就是層的大小。”

另一位用戶則看出了一些端倪,辣評“過去七年,LLM 架構有很多改進,但沒有根本性的創新。今天最好的開放權重模型,如果你縮遠了看,仍然很像 GPT-2,就是一堆注意力層和前饋層堆起來。”

這可以說是一個重要的觀察。LLM 能力的驚人提升,更多來自訓練方法的革新。比如 RLVR(Reinforcement Learning with Verifiable Rewards,可驗證獎勵的強化學習),而不是架構本身的突破。架構層面的優化,更多是爲了讓訓練和推理更高效、成本更低,而不是讓模型根本上更聰明。理解這一點,對選型和預期管理都有幫助。

最後總結一下,這個大模型架構的圖集的實際用法很簡單。

首先,你可以把它當作速查手冊:想知道 Qwen3 和 DeepSeek V3 在注意力機制上有什麼區別?打開頁面,找到兩張圖,直接對比。規格表裏會告訴你 Qwen3 用 GQA,DeepSeek V3 用 MLA;前者沒有共享專家,後者有。

其次,每張架構圖都鏈接到 Raschka 原文中的對應章節,如果你想深入瞭解某個技術細節:比如 QK-Norm(一種應用於查詢和鍵向量的歸一化技術)是什麼、爲什麼能穩定訓練,點進去就能讀到解釋。

第三,圖集附帶一份“概念速查”,解釋 GQA、MLA、SWA(Sliding Window Attention,滑動窗口注意力)、NoPE(No Positional Encoding,無位置編碼)、Gated DeltaNet 等術語,適合快速補課。

並且,正如 Karpathy 的用法所示,這份圖集的價值不僅在於人類可讀,還在於它的結構化程度足以被機器解析。Raschka 在 GitHub 上提供了 YAML 格式的元數據,包含每個模型的參數量、發佈日期、技術報告鏈接、注意力類型等字段。如果你想寫腳本批量分析這些模型的共性和差異,或者像 Karpathy 那樣把它們餵給 AI 做自動化研究,這份元數據是現成的起點。

Raschka 還把整套架構圖打包成一個超高分辨率的 PNG 文件(56M,182 百萬像素,上傳到 Zazzle,可以直接下單打印成實體海報。他自己也訂了一張,但“還沒收到貨,暫時不能保證印刷質量”。頁面底部留了一個 Issue Tracker 鏈接,歡迎任何人提交糾錯或建議。

對於正在選型的工程師來說,這份圖集的價值在於節省時間。你不用再翻幾十頁技術報告去找一個數字,也不用自己畫對比表格。對於想搞懂“這些模型到底在結構上有什麼區別”的研究者來說,統一的視覺語言讓跨模型對比成爲可能。

參考鏈接:

1.項目地址:

https://sebastianraschka.com/llm-architecture-gallery/#card-qwen3-5-397b

2.開發者主頁:

https://x.com/rasbt/status/2033167146302210058

運營/排版:何晨龍