長期以來,我們對於 AI“奇點”似乎總是這樣的:一臺超級機器,不斷自我迭代,像黑洞一樣吞噬一切認知能力,最終升格爲某種硅基神靈。但一篇剛剛發表在《科學》(Science)上的評論文章對這種想法進行了根本性的反駁,研究團隊認爲,智能爆炸不會以“獨裁者”的面目出現。它更像一座不斷擴張的城市,而非一個不斷膨脹的大腦。

這篇文章題爲《Agentic AI and the next intelligence explosion》,由芝加哥大學社會學與數據科學教授 James Evans、加州大學聖迭戈分校技術哲學教授 Benjamin Bratton,以及谷歌副總裁兼 Fellow Blaise Agüera y Arcas 聯合撰寫。

圖丨從左到右分別是 James Evans、Benjamin Bratton、Blaise Agüera y Arcas(來源:Wikipedia)

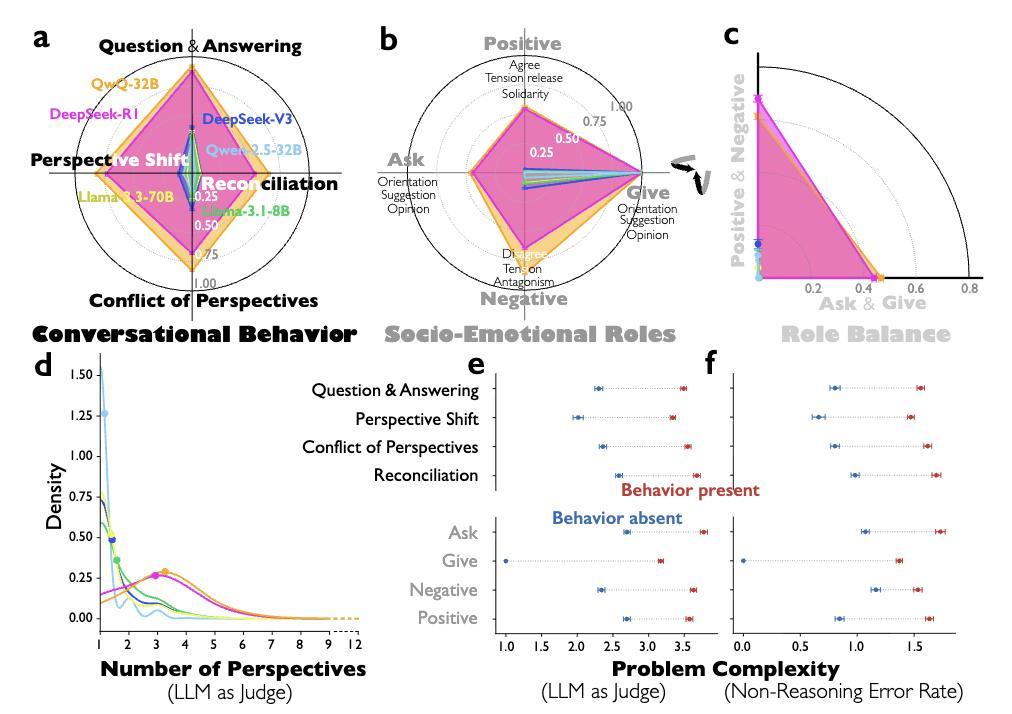

文章的第一個關鍵論據來自一項此前由同一團隊發表的實證研究。他們發現,當前最強的推理模型,如 DeepSeek-R1 和阿里的 QwQ-32B,並不是靠“想得更久”來提升表現的。真正起作用的,是這些模型在推理鏈(chain of thought)內部自發生成了一種類似“多智能體辯論”的結構,研究者將其命名爲“思想社會”(society of thought)。

簡單說,模型在解決一道複雜化學題時,不會沿着一條線性邏輯走到底,而是會“分裂”出具有不同認知風格的內部角色:一個憑直覺提出假設的“聯想專家”,一個立刻質疑它的“批判驗證者”,以及負責調和衝突的“整合者”。這些角色的人格特徵甚至可以用大五人格量表來度量。

圖丨鏈式思維推理中的對話行爲和 Bales 社會情感角色(來源:arXiv)

且讓人意外的是,這種行爲是湧現的。沒有任何訓練信號明確要求模型進行多角色辯論。當強化學習只以“答案正確”作爲獎勵函數時,模型自發地增加了內部對話行爲。研究團隊還做了一項因果驗證實驗:他們使用稀疏自編碼器(Sparse Autoencoder)在 DeepSeek-R1 的激活空間中找到了一個與“驚訝/頓悟”語義高度相關的特徵向量,通過人爲增強該特徵,模型在算術推理任務上的準確率從 27.1% 幾乎翻倍到 54.8%。

抑制這個特徵,對話行爲減少,表現也隨之下降。換言之,推理模型的能力優勢,可以因果地歸因於它們內部的“社會過程”。

三位作者由此跳出了 AI 技術的範疇,把視野拉到了整個智能演化史。他們的核心主張是:歷史上每一次“智能爆炸”,都不是個體認知硬件的升級,而是一種新的社會化認知單元的誕生。靈長類的智能與社羣規模正相關,而非環境難度。人類語言開啓了發展心理學家 Michael Tomasello 所說的“文化棘輪”(cultural ratchet),知識跨代積累而無需每個個體從頭重建;文字、法律和官僚體制則把社會智能外化爲基礎設施。一個管理穀物賬目的蘇美爾書吏並不理解他所在系統的宏觀經濟功能,但那個系統在功能上比他更聰明。

按照這個框架,大語言模型是同一條線索的最新延伸。它們訓練於人類社會認知的累積輸出,每一個參數都是交流互動的壓縮殘留。遷移到硅基的並非抽象推理能力,而是外化形式的社會智能。

既然智能天然是社會性的,那麼通往更強 AI 的路徑就不在於造一個全知全能的“神諭”,而在於組合出更豐富的混合系統。文章在這裏借用了國際象棋界的老概念:半人馬(centaur)。1998 年卡斯帕羅夫輸給“深藍”之後,他提出了“人機協作賽”的想法,人類棋手加上 AI 輔助,組合成“半人馬選手”,能擊敗單獨運行的最強 AI。

Evans 等人把這個概念推廣到了更一般的場景:一個人指揮多個 AI 智能體,一個 AI 服務於多個人類,或者更復雜的多人多機協作。我們每個人可能每天進出多種這樣的組合,多數時候甚至沒有意識到。

圖丨深藍 AI(來源:IBM)

由此引出的問題就不再是“AI 會不會超過人類”這樣的科幻命題了,而是更現實的治理難題。文章銳評道,當前 AI 對齊的主流範式如基於人類反饋的強化學習(RLHF),本質上是一種“親子模型”的糾錯方式,是雙人對話式的,無法擴展到數十億智能體的規模。

取而代之的應該是“制度性對齊”(institutional alignment):就像人類社會不依賴個人美德而依賴法庭、市場、官僚制度等角色化的制度模板一樣,可擴展的 AI 生態也需要數字化的等價物。法庭之所以運轉,不是因爲某個具體的人是法官,而是因爲“法官”、“律師”、“陪審團”是定義清晰的角色槽位,誰坐上去並不影響系統功能。

文章還討論了開年來爆火的 OpenClaw 及其衍生智能體社交網絡 Moltbook,認爲它們代表了智能體的自我複製與分化的萌芽。當一個 AI 智能體面對複雜任務時,它可以複製自己、分配子任務、再合併結果。如果其中一個“分身”遇到了超出能力的子問題,它可以進一步生成自己的內部“思想社會”,形成一種遞歸式的集體審議,在複雜性需要時展開,在問題解決後收縮。衝突在這裏不是 bug,而是資源。

如果再把這套邏輯推到政府治理層面,當 AI 系統被部署於招聘、量刑、福利分配等高風險決策時,“誰來審計審計者”這個問題就無可迴避了。文章認爲其答案可能是憲政性的:政府需要具備不同價值取向的 AI 系統(透明度、公平性、正當程序)來相互制衡。

一個勞工部門的 AI 可以審計企業招聘算法的歧視性影響,一個司法分支的 AI 可以評估行政分支 AI 的風險評估是否符合憲法標準。而如果不這樣做呢?文章半帶嘲諷地給出了替代方案:讓金融監管機構繼續派一羣拿着 Excel 表格的商學院畢業生,去對付已經用 AI 武裝到牙齒的華爾街算法交易。

三位作者給出了一個非常剋制的收尾:我們描述的這個願景既不是烏托邦,也不是反烏托邦,而是演化性的。任何即將發生的智能爆炸,都將由 80 億人與數千億乃至萬億 AI 智能體的交互所催生。它的腳手架不是一個不斷攀升的單一心智,而是一個不斷複雜化的組合式社會。智能像一座城市那樣生長,而非像一個超級大腦那樣膨脹。

用文章結尾的話說:沒有任何心智是一座孤島。

參考資料:

1.https://www.science.org/doi/10.1126/science.aeg1895

2.https://arxiv.org/pdf/2601.10825

運營/排版:何晨龍