一個只有2000億參數的AI模型,性能快追上美國最頂流的大模型了。而且它能在華爲的芯片上跑。

這不是科幻,是剛剛發生的事。

DeepSeek在2月11日悄悄上線了一個新模型,叫V4 Lite,輕量版的意思。當時沒人在意,畢竟2000億參數在今天的AI圈確實算“小個子”,主流大模型早就奔着萬億去了 。

但接下來半個月,這個模型一直在悄悄升級。2月27日,有網友測試發現它的性能越來越強。到3月2日的一次更新後,Linux Do社區的開發者HCPTangHY測完直接懵了,說在他的測試裏,這已經是國模SOTA——就是國內第一梯隊的意思 。

更具體的數據是,這個0302版本的分數已經逼近目前全球最頂流的閉源模型Sonnet 4.6 。一個2000億參數的輕量版,快追上別人家的旗艦了。

這事的反常識在於,參數少不等於能力弱。

過去一年,國產大模型在對話聊天方面已經跟閉源模型差別不大,但在多模態、編程、數學這些硬核能力上一直被甩開。最近發佈的GLM5、MiniMax 2.5、Qwen 3.5都有提升,但人家Anthropic、OpenAI、谷歌也沒閒着,差距又拉開了 。

DeepSeek這次的路子不太一樣。V4 Lite的核心突破是兩個:100萬token上下文窗口,和原生多模態 。

100萬token什麼概念?相當於能一次性處理750本中等厚度的小說,或者一箇中型公司的完整代碼倉庫 。以前DeepSeek V3.2只有12.8萬token,這次直接翻了近8倍 。

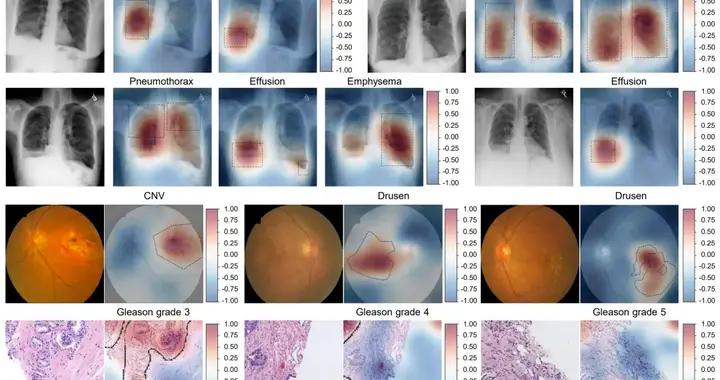

原生多模態的意思是,模型從孃胎裏就能看懂圖片,不是後期外掛一個視覺模塊拼起來的 。這玩意的重要性在於,文圖對齊的能力通常遠優於拼接方案,能更精準地理解“圖裏在說什麼”,也能更連貫地生成“符合語義的圖像內容” 。

有測試者用V4 Lite生成了一個Xbox 360手柄的SVG圖像代碼,只用了54行,結構層次清晰,細節準確。還有個“騎自行車的鵜鶘”,42行代碼,多元素場景構圖自然流暢 。這兩項輸出在代碼精簡度、邏輯組織和視覺還原度上,都優於DeepSeek V3.2、Claude Opus 4.6和Gemini 3.1 。

更扎心的是,V4 Lite是在非思考模式下生成的,而對比的V3.2是開了深度思考的 。一個沒動腦子的輕量版,幹翻了動腦子的上一代旗艦。

但真正讓行業內震動的,不是這些參數和測試數據。

路透社2月26日爆出一條消息:DeepSeek在即將發佈V4之前,沒有按行業慣例給英偉達和AMD提供預發佈版本,而是給了華爲等中國芯片廠商數週的“優先期”,讓他們提前適配優化 。

行業慣例是什麼?AI開發者通常會在重大模型更新前,把預覽版分享給英偉達和AMD這些芯片巨頭,確保軟件能在主流硬件上高效運行。DeepSeek之前也一直跟英偉達技術團隊密切合作 。

但這次變了。消息人士說,DeepSeek給了包括華爲在內的中國芯片廠商幾周時間,針對自家處理器做軟件適配與性能優化 。英偉達和AMD拒絕評論,DeepSeek和華爲也沒回應 。

這意味着什麼?

有分析說,這標誌着DeepSeek在生態佈局上做了新的取捨:把適配重心前移至國產計算平臺,爲本土芯片企業預留充分時間,開展底層指令集、算子庫及推理框架層面的深度協同優化 。簡單說,就是要讓國產大模型能在國產芯片上跑起來,而且跑得好。

有開發者測算過,V4 Lite的百萬級上下文推理成本可能低於同類產品的十分之一 。這種成本優勢如果屬實,將重塑AI應用生態。而華爲拿到優先適配權,意味着這套成本優勢可能首先在國產算力上落地。

CNBC已經發出預警:DeepSeek一旦正式發佈新模型,可能觸發類似V3發佈時納斯達克3%單日跌幅的市場反應 。華爾街正屏息以待。

有人在X平臺上說:“我的Claude訂閱3月4日就到期了,希望DeepSeek在那之前能發佈他們的模型。” 還有人評論:“參數規模或許不是重點,長上下文與多模態的結合纔是革命性突破。”

當然,也有冷靜的聲音。有開發者指出,SVG測試只是窄測試項,不能代表推理、多步驟編程等核心能力的全貌 。參數量約2000億仍屬猜測,“輕量版”意味着某處有取捨,取捨在哪裏尚不明朗 。

但有一個細節值得反覆琢磨:DeepSeek這次的策略調整,是把適配重心從美國芯片轉向了中國芯片。在重大模型更新前不給英偉達內測資格,這在大模型行業裏是第一次。

一個網友評論:“輕量版不是功能弱,是成本更低。這是個成本優化的強力產品。”

2000億參數的模型,性能逼近美國頂流,能在華爲芯片上跑,推理成本可能只有別人的十分之一。這四個事實放在一起,拼出來的圖景已經不是某個公司的技術突破,而是整個國產AI產業鏈條的咬合。

完整版V4據說參數可能突破1萬億 ,發佈時間就在這幾天 。到時候會是什麼動靜,誰也不知道。

但至少現在,那個叫“sealion-lite”的海獅,已經悄悄下水了 。