來源:中科院之聲作者:中國科學院深圳先進技術研究院

醫學影像往往隱藏着大量關鍵信息,但要讓AI看懂這些影像,此前訓練數據離不開醫生圈出病竈——這不僅耗費大量時間和精力,也讓醫學影像AI難以大規模推廣。

最近,中國科學院深圳先進技術研究院等提出了一種名爲AFLoc的人工智能模型。這一模型不需要醫生提前標註病竈,就能自動在醫學影像中“找病竈”。

01

學習能力強

傳統醫學影像AI的學習方式,就像學生做題必須先有標準答案。而AFLoc更像是在“看圖讀報告”的過程中,自行學會理解影像含義。

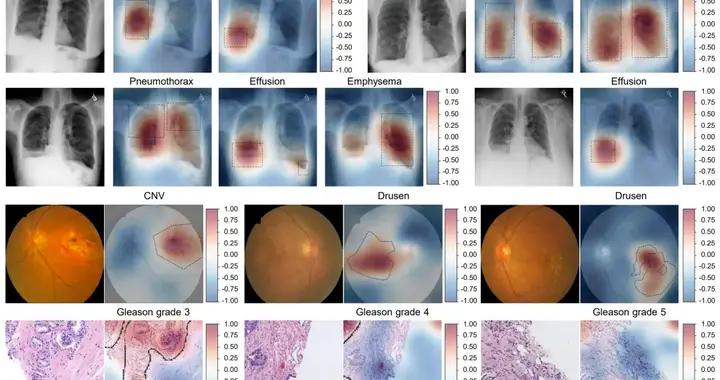

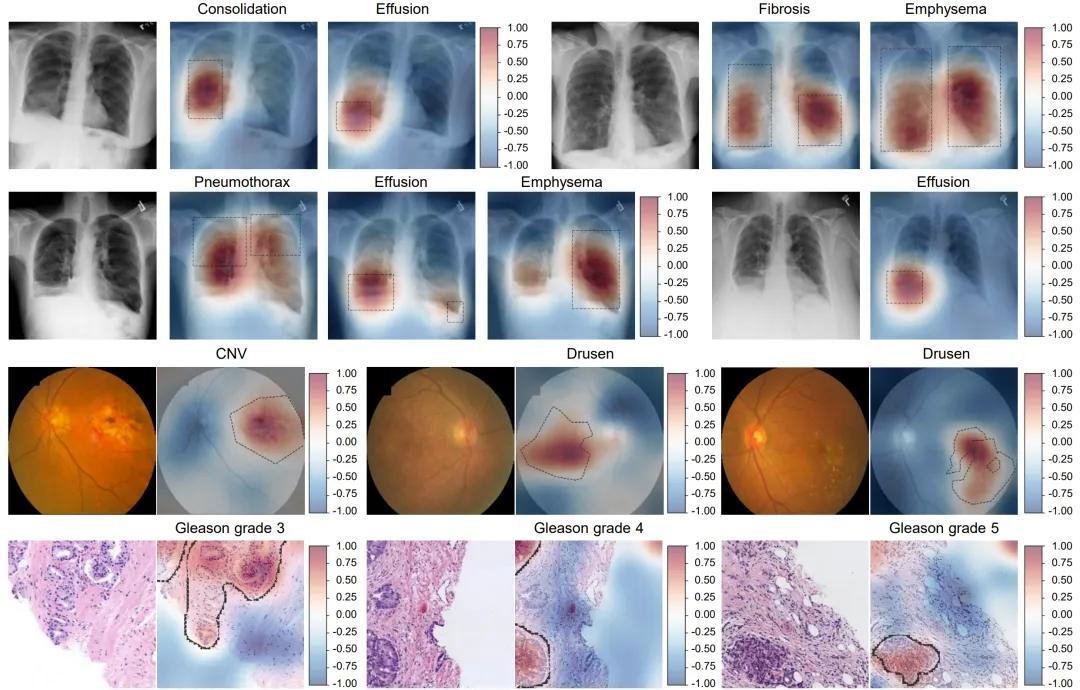

AFLoc模型自動定位的病竈區域。研究團隊供圖

研究人員讓AI同時學習兩類信息:一類是醫學影像本身,比如胸片、眼底照片或病理切片;另一類是醫生撰寫的臨牀報告。

通過反覆“對照學習”,AI會逐漸“明白”報告中提到的疾病描述,對應影像中的哪些區域最重要。久而久之,即使沒有人工標註,AI也能根據一句疾病描述,在影像中準確標出最可能的病竈位置。

研究團隊在3種常見醫學影像中驗證了AFLoc的能力,包括胸部X光、眼底影像和組織病理圖像。

在胸片實驗中,AFLoc針對肺炎、胸腔積液、氣胸等34種常見疾病,在多個公開數據集上的病竈定位效果優於現有方法,在部分疾病上甚至超過了人類專家的水平。

在眼底和病理影像中,AFLoc同樣表現穩定,能夠清晰、準確地定位病變區域。

更令人關注的是,在完全沒有見過標註數據的情況下,AFLoc依然具備出色的疾病判斷能力。在多項“零樣本”測試中,它的表現甚至超過了部分依賴大量人工標註數據訓練的模型。

02

打開“自學”新途徑

這項研究表明,醫學影像AI不再必須建立在大量“手工畫圈”的數據基礎之上,只要有影像和臨牀報告,AI就能不斷自我學習和提升。

這不僅能大幅降低醫學影像AI的研發成本,也有助於模型在不同醫院、不同設備之間更好地“舉一反三”,提高了真實臨牀環境中的實用性。

研究團隊表示,未來將進一步推動該技術在真實臨牀場景中的驗證和應用,探索其在輔助診斷、疾病篩查等方面的潛力。

☟